大模型有了 “身体”!魔珐星云实测:无 GPU 跑 3D 数字人,6 大优势破三角

魔珐星云平台通过低门槛、免GPU渲染技术,让开发者快速构建具身智能数字人。平台提供电影级渲染效果、低延迟交互和多终端适配能力,支持从注册体验到SDK开发的完整流程。文章实测演示了从创建数字人应用到本地环境部署的全过程,展示了AI导览助手等场景的实现方案,打破传统数字人开发的高成本壁垒,让企业及个人开发者都能轻松实现智能数字人落地。

文章目录

前言

在大模型普及的当下,我们早已习惯用 AI 聊方案、生成内容,但文字与语音的交互总缺了点 “温度”—— 这些智能虽能 “思考”,却仍是困在服务器里的 “无身大脑”。

而曾经令人向往的数字人,高昂的 GPU 渲染成本、专业建模门槛,让普通开发者望而却步,生动虚拟体只存在于科幻想象中。

直到魔珐星云的出现:低延迟、免显卡、多端适配,直接打破数字人开发的高门槛,让企业用得起、开发者玩得转。耳听为虚,我亲手实测:从注册配置到基于 SDK 开发 “AI 导览助手”,完整拆解具身智能数字人的落地全流程。

一、初识魔珐星云:具身智能数字人的开放入口

1.1 平台定位:让 “无身大模型” 拥有 “实体” 的基础设施

魔珐星云的核心定位,是打破 “智能与实体脱节” 的困局,成为连接大模型与物理世界的 “具身智能基础设施”。它并非单纯的数字人生成工具,而是全栈式 AI 数字人能力开放体系,核心价值体现在两大维度:

- 其一,向上快速承接 DeepSeek、文心等主流大模型能力,无需复杂适配,让数字人直接拥有逻辑推理、多轮对话等智能;

- 其二,向下输出标准化实体能力,将高精度驱动、微表情呈现、无 GPU 端侧渲染、多终端适配等核心技术封装为模块,大幅降低开发门槛。

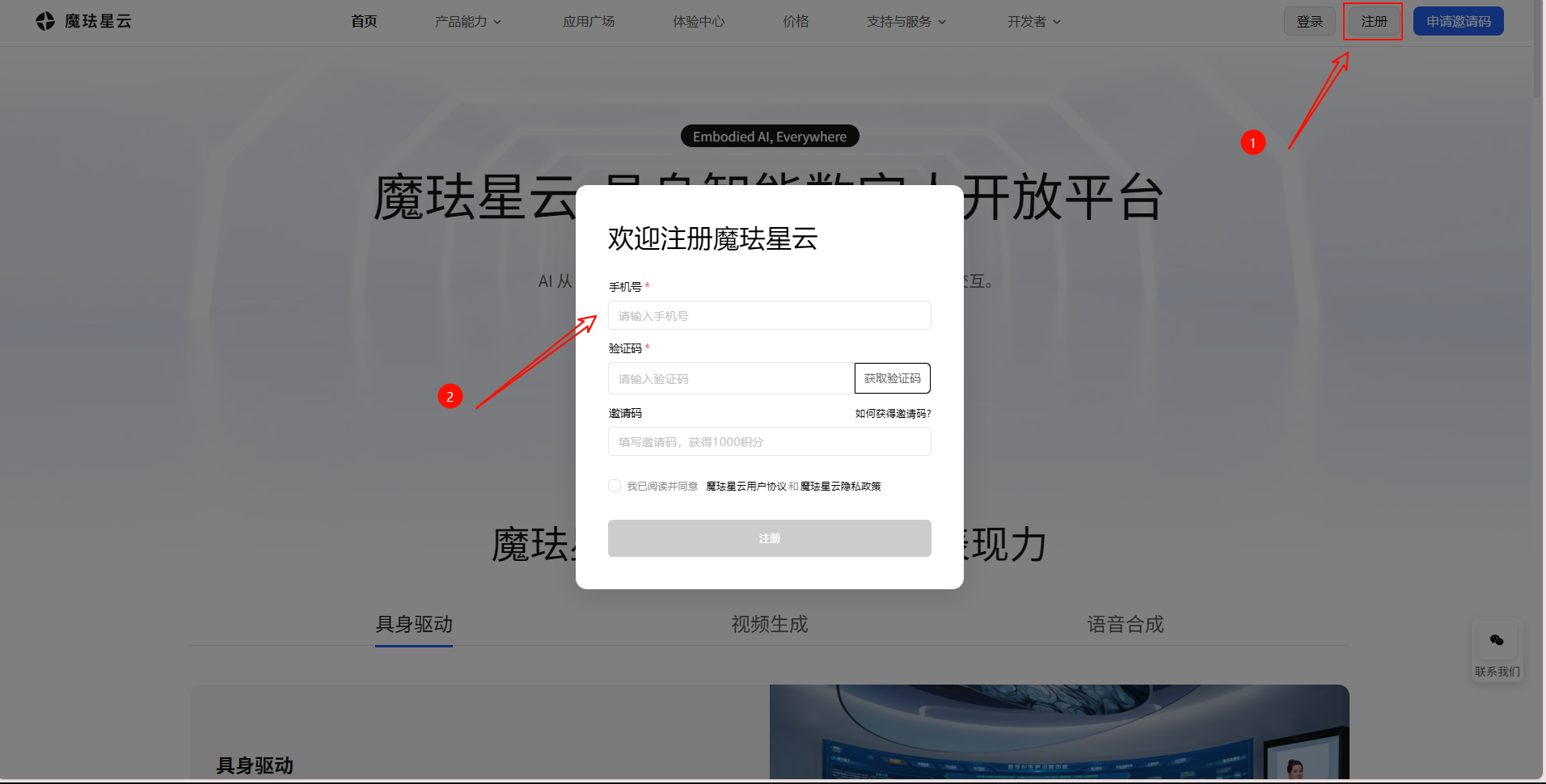

1.2 快速上手:注册 + 体验中心的入门流程

开魔珐星云 官网链接,点击页面右上角的 “注册” 按钮,只需填写账号、获取并输入验证码、设置密码这几步,就能完成账号注册,开启具身智能数字人的体验之旅。

完成注册并登录账号后,就能直接进入体验界面与 3D 数字人碰面 —— 接下来我们就实际和这个超写实数字人来一场自然对话,直观感受它的交互流畅度与真实感。

PixPin_2025-12-06_21-14-40

看完这段互动演示就能直观感受到:不用任何开发基础,登录后就能直接和超写实 3D 数字人实现自然对话,微表情与动作的同步流畅度,完全不像 “入门级体验” 的水准。体验中心相当于给开发者开了个 “试玩窗口”—— 不用先啃复杂文档,先直观摸到数字人的交互质感,再动手开发会更有方向。

1.3 预览体验:数字人核心功能的场景化演示

接下来我们演示数字人的播报功能 —— 让这个可爱的二次元数字人,为我们介绍刘震云的作品《一句顶一万句》,直观体验它的内容讲解能力。

PixPin_2025-12-06_21-24-23

从这段演示可直观感知数字人播报功能的细节表现力:讲解《一句顶一万句》时,语音节奏会贴合内容调性 —— 提及作品核心的 “语言与人际关系” 主题时,语调会自然放缓,同时伴随轻抬手臂的动作来强化表达重点,让文字内容的解读更具层次感。

这种 “内容 + 语音 + 肢体动作” 的协同表现,适配书籍推荐、文化科普等场景,能将单向的内容输出转化为更有代入感的互动讲解。而这只是数字人基础功能的展示,后续通过 SDK 开发,还可接入更多内容库,实现更个性化的场景化内容播报。

二、核心优势拆解:无 GPU 跑 3D 数字人,打破开发 “不可能三角”

2.1 高质量 × 交互:电影级渲染 + 低延时打断式对话

靠自研 3D 多模态大模型撑住双优势:

- 高质量:180 + 面部控制点精准驱动微表情,皮肤纹理、光影效果直接拉满电影级质感;

- 强交互:端到端延迟<1.5 秒,对话时能随时打断,数字人会同步调整语气、表情、手势 —— 彻底告别 “预录动作的生硬感”,高质量渲染和自然交互不再是二选一。

2.2 性能 × 成本:高并发支持 + 无 GPU 运行的低投入门槛

把 “高并发” 和 “低成本” 这对矛盾点直接打通:

- 性能端:千万级并发承载力,政务大厅、展馆等场景 “百人同时互动也不卡顿”;

- 成本端:创新云 - 端架构让端侧不用 GPU,仅靠 RK3566 这类百元级芯片就能流畅跑通 —— 中小团队、个人开发者也能负担,高并发和低成本终于能同时兼顾。

2.3 兼容 × 场景:多终端适配 + 多风格数字人选择

解决 “终端受限、风格单一” 的老问题:

- 全终端兼容:手机 / 车机 / AR 头显 / 信创设备一键适配,消费级、工业级场景都能覆盖;

- 多风格定制:超写实政务员工、二次元科普形象、虚拟 IP 角色一键切换 —— 全终端兼容和风格精准匹配,不用再做取舍。

三、SDK 实战:从 0 到 1 搭建 “AI 导览助手”

3.1 开发准备:注册与数字人应用创建

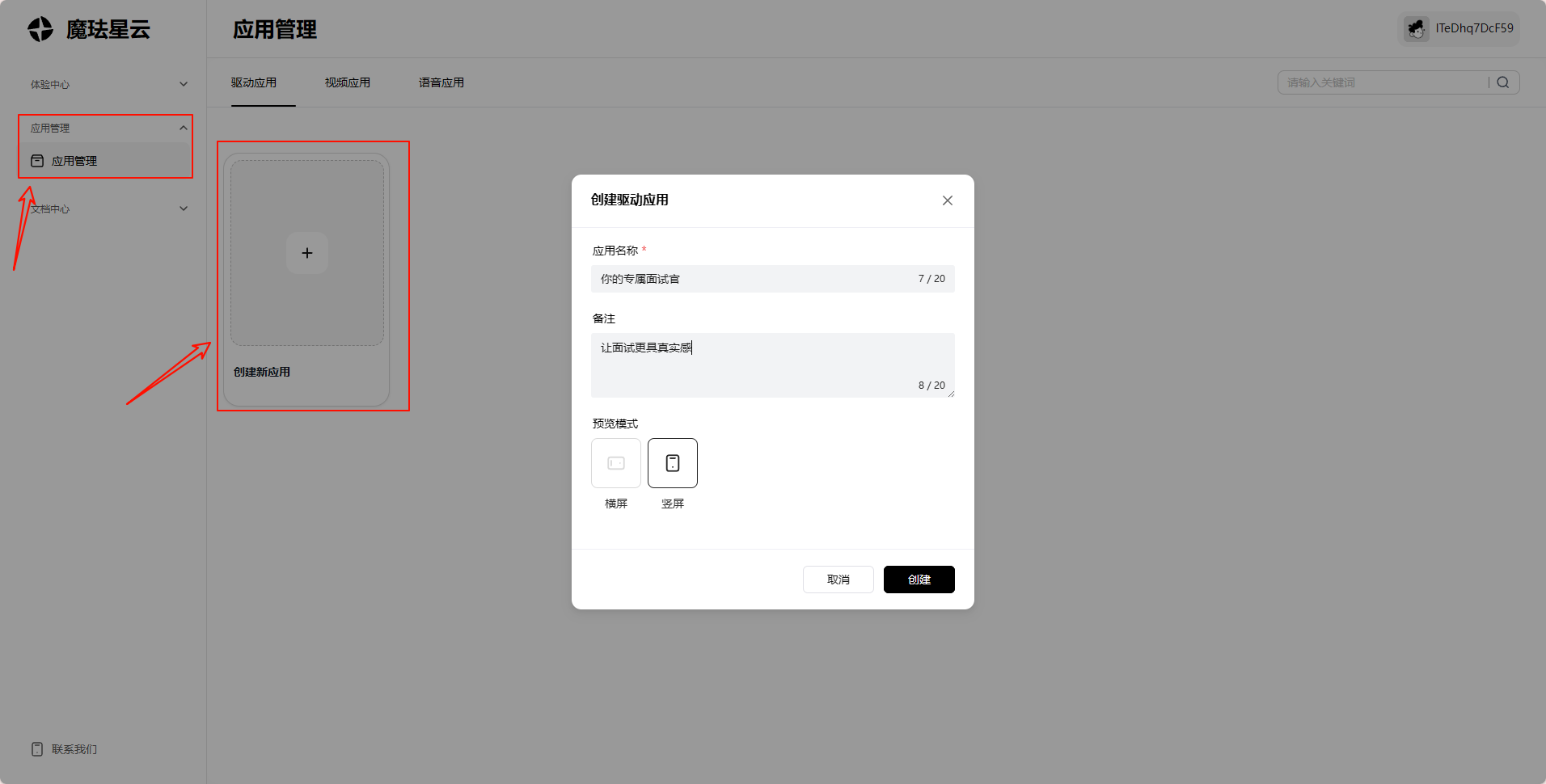

点击平台界面的 “应用管理” 入口,进入应用管理页面;点击 “创建应用” 按钮,填写应用名称等基础信息,即可快速生成专属的数字人应用项目。

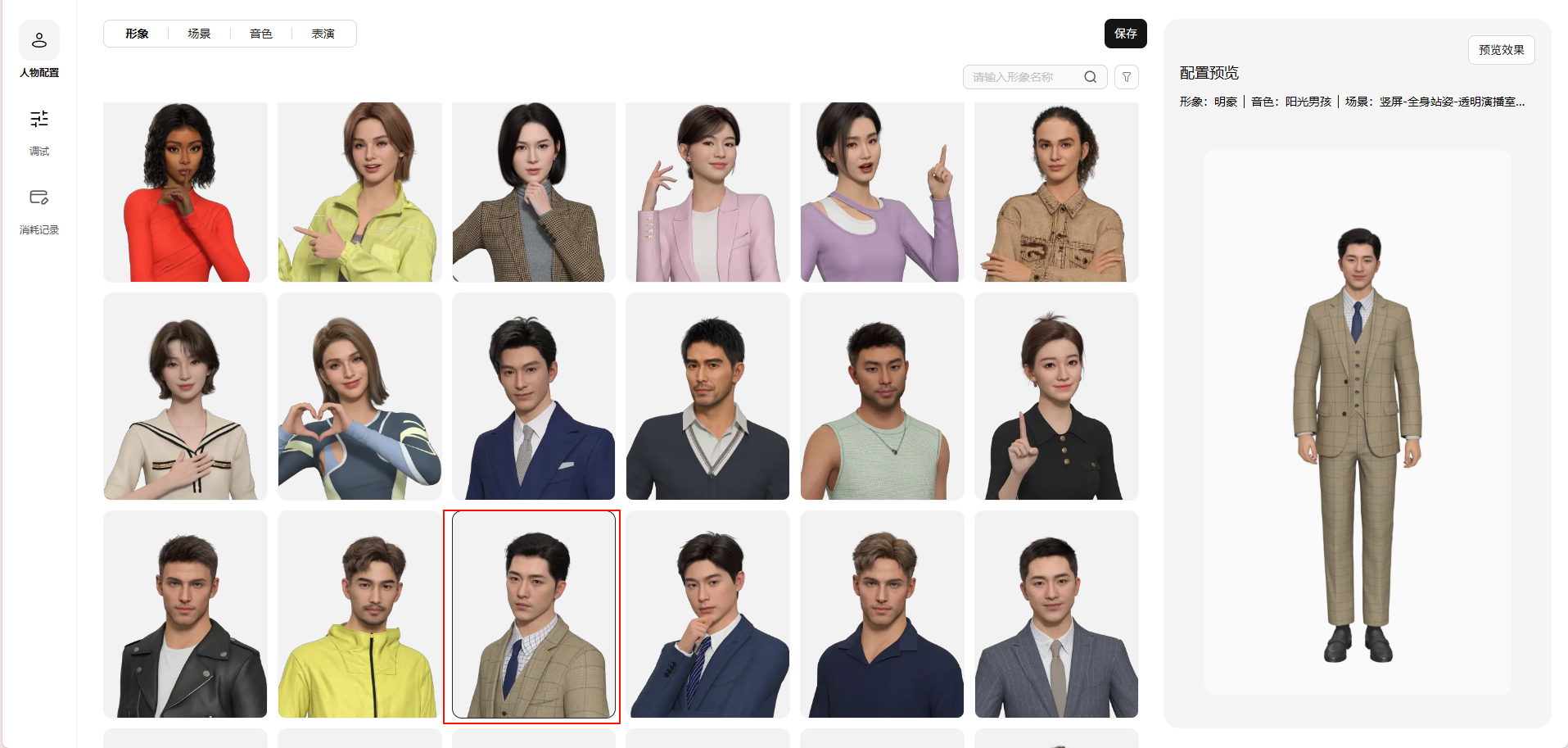

随后进入人物模型选择环节:平台提供了风格多元的数字人模型库,涵盖不同形象、着装风格的虚拟角色,直接点击心仪的模型即可完成选定,快速匹配适配开发场景的数字人形象。

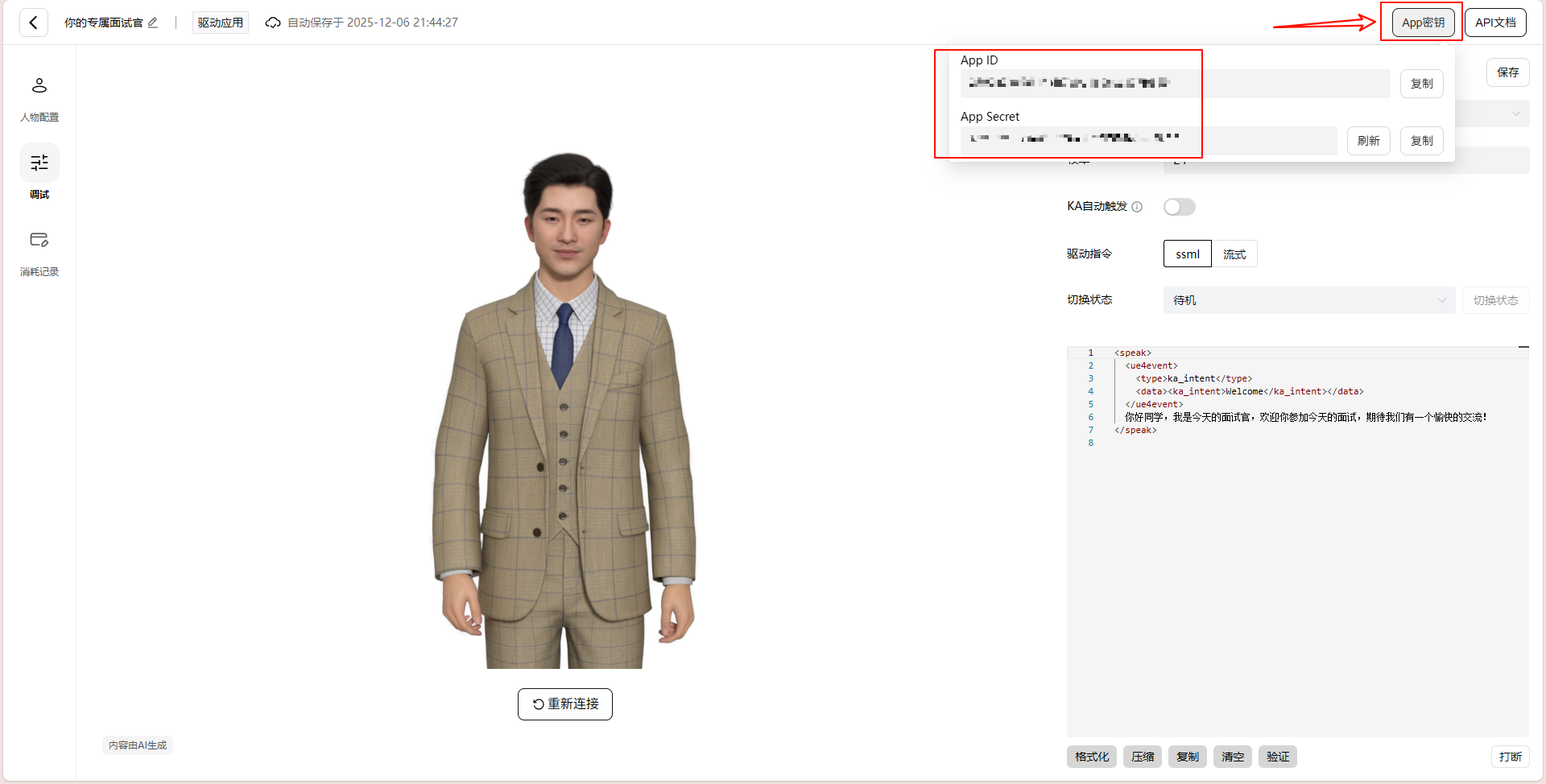

完成数字人形象与功能配置后,即可开启交互环节 —— 我们让这个形象专业的 AI 面试官,演示一段面试开场白,直观感受数字人在场景化场景下的表达效果。

PixPin_2025-12-06_22-33-27

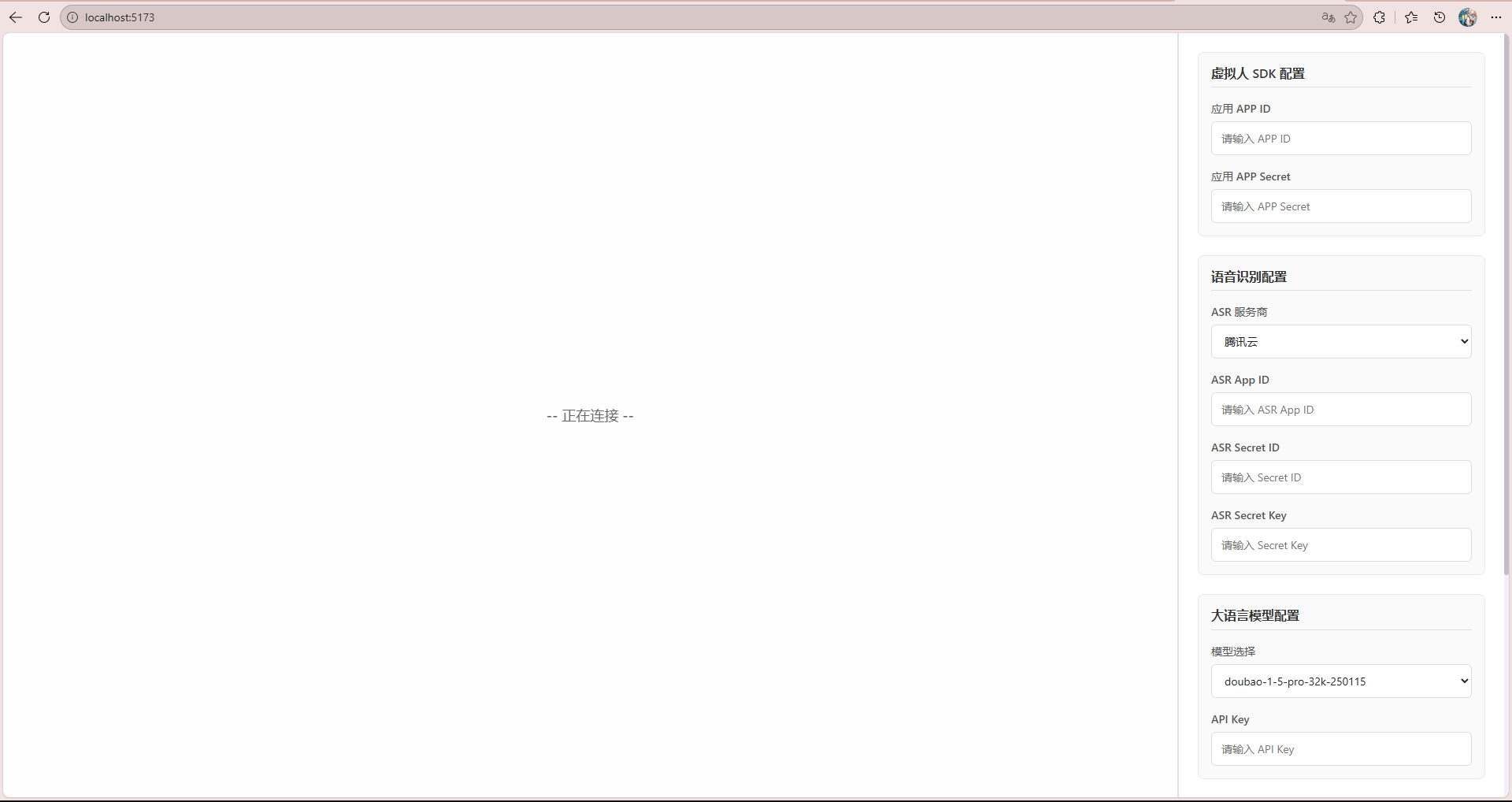

3.2 环境部署:本地开发环境的快速配置

首先从官方文档处下载「数字人实时驱动 Demo」,随后参照文档内的环境要求,完成本地开发环境的配置。

通过命令行查询工具版本,确认环境依赖已正确安装:

(以下为实际验证命令及结果示例)

PS C:\WINDOWS\system32> vue --version

@vue/cli 5.0.9

PS C:\WINDOWS\system32> vite -v

vite/7.2.0 win32-x64 node-v24.11.1

3.3 Demo 启动:数字人实时驱动的基础调试

这是一个基于Vue 3 + TypeScript + Vite的数字人交互演示项目,集成了星云数字人SDK、腾讯云语音识别(ASR)和多种大语言模型(LLM)。

src/

├── App.vue # 应用主组件

├── main.ts # 应用入口

├── style.css # 全局样式

├── vite-env.d.ts # Vite环境类型声明

├── components/ # Vue组件

│ ├── AvatarRender.vue # 虚拟人渲染组件

│ └── ConfigPanel.vue # 配置面板组件

├── stores/ # 状态管理

│ ├── app.ts # 应用状态和业务逻辑

│ └── sdk-test.html # SDK测试页面

├── services/ # 服务层

│ ├── avatar.ts # 虚拟人SDK服务

│ └── llm.ts # 大语言模型服务

├── composables/ # Vue组合式函数

│ └── useAsr.ts # 语音识别Hook

├── types/ # TypeScript类型定义

│ └── index.ts # 统一类型导出

├── constants/ # 常量定义

│ └── index.ts # 应用常量

├── utils/ # 工具函数

│ ├── index.ts # 通用工具函数

│ └── sdk-loader.ts # SDK加载器

├── lib/ # 第三方库封装

│ └── asr.ts # 语音识别底层服务

└── assets/ # 静态资源

├── siri.png # 语音识别动画图标

└── vue.svg # Vue Logo

下载完成后,通过 VS Code 打开该项目文件,依次执行以下两条指令,即可启动数字人实时驱动 Demo::

指令:

npm i

说明:执行后,npm 会自动识别项目根目录下的package.json文件,下载并安装文件中声明的所有依赖包。

执行结果示例:

added 50 packages, and audited 51 packages in 3m

6 packages are looking for funding

run `npm fund` for details

1 moderate severity vulnerability

To address all issues, run:

npm audit fix --force

Run `npm audit` for details.

在index.html中引入魔珐星云SDK脚本:

<!doctype html>

<html lang="en">

<head>

<meta charset="UTF-8" />

<link rel="icon" type="image/svg+xml" href="/vite.svg" />

<meta name="viewport" content="width=device-width, initial-scale=1.0" />

<title>Vite + Vue + TS</title>

</head>

<body>

<div id="app"></div>

<script type="module" src="/src/main.ts"></script>

<!-- 引入魔珐星云SDK -->

<script src="https://media.xingyun3d.com/xingyun3d/general/litesdk/xmovAvatar.0.1.0-alpha.15.js"></script>

<script src="/cryptojs.js"></script>

<script src="/speechrecognizer.js"></script>

</body>

</html>

- 这一步非常的关键,务必注意!

指令:

npm run dev

说明:该指令会执行package.json中scripts字段定义的dev脚本,启动 Demo 的本地开发服务。

执行结果示例:

> demo@0.0.0 dev

> vite

VITE v7.1.2 ready in 669 ms

➜ Local: http://localhost:5173/

➜ Network: use --host to expose

➜ press h + enter to show help

在浏览器中输入地址 http://localhost:5173/,即可打开数字人实时驱动 Demo 的交互平台。

3.4 代码讲解:魔珐星云 SDK 的接入与驱动

在这个 Demo 项目中,魔珐星云SDK(XmovAvatar)的接入和驱动是通过一系列模块化的方式实现的。以下是详细的接入流程和使用方法:

在index.html中引入魔珐星云SDK脚本:

<!doctype html>

<html lang="en">

<head>

<meta charset="UTF-8" />

<link rel="icon" type="image/svg+xml" href="/vite.svg" />

<meta name="viewport" content="width=device-width, initial-scale=1.0" />

<title>Vite + Vue + TS</title>

</head>

<body>

<div id="app"></div>

<script type="module" src="/src/main.ts"></script>

<!-- 引入魔珐星云SDK -->

<script src="https://media.xingyun3d.com/xingyun3d/general/litesdk/xmovAvatar.0.1.0-alpha.15.js"></script>

<script src="/cryptojs.js"></script>

<script src="/speechrecognizer.js"></script>

</body>

</html>

- 这一步非常的关键,务必注意!

动态加载与初始化:

项目使用 src/utils/sdk-loader.ts 实现了SDK的动态加载和管理:

// 动态加载SDK

export function loadSDK(src: string): Promise<void> {

return new Promise((resolve, reject) => {

// 检查是否已经加载

const existingScript = document.querySelector(`script[src="${src}"]`)

if (existingScript) {

resolve()

return

}

const script = document.createElement('script')

script.src = src

script.onload = () => resolve()

script.onerror = () => reject(new Error(`Failed to load script: ${src}`))

document.head.appendChild(script)

})

}

// 确保所有SDK加载完成

export async function ensureSDKsLoaded(): Promise<boolean> {

try {

// 尝试加载本地和CDN SDK

await Promise.all([

loadSDK('/cryptojs.js'),

loadSDK('/speechrecognizer.js'),

loadSDK('https://media.xingyun3d.com/xingyun3d/general/litesdk/xmovAvatar.0.1.0-alpha.63.js')

])

// 等待SDK初始化

await Promise.all([

waitForSDK('cryptoJS'),

waitForSDK('speechRecognizer'),

waitForSDK('xmovAvatar')

])

console.log('所有SDK加载完成')

return true

} catch (error) {

console.error('SDK加载失败:', error)

return false

}

}

应用启动时初始化:

在 src/main.ts 中,应用启动时会首先初始化SDK:

async function initApp() {

console.log('开始初始化应用...')

// 初始化SDK

const sdkLoaded = await initSDKs()

if (sdkLoaded) {

console.log('SDK初始化成功')

checkSDKStatus()

} else {

console.error('SDK初始化失败,应用可能无法正常工作')

}

// 创建Vue应用

const app = createApp(App)

app.mount('#app')

console.log('应用初始化完成')

}

连接虚拟人:

项目在 src/services/avatar.ts 中封装了魔珐星云SDK的核心功能连接虚拟人:

// 连接虚拟人

async connect(config: AvatarConfig, callbacks: AvatarCallbacks): Promise<any> {

const { appId, appSecret } = config

const { onSubtitleOn, onSubtitleOff, onStateChange } = callbacks

// 构建网关URL

const url = new URL(SDK_CONFIG.GATEWAY_URL)

url.searchParams.append('data_source', SDK_CONFIG.DATA_SOURCE)

url.searchParams.append('custom_id', SDK_CONFIG.CUSTOM_ID)

// SDK构造选项

const constructorOptions = {

containerId: `#${this.containerId}`,

appId,

appSecret,

enableDebugger: false,

gatewayServer: url.toString(),

onWidgetEvent: (event: any) => {

console.log('SDK事件:', event)

if (event.type === 'subtitle_on') {

onSubtitleOn(event.text)

} else if (event.type === 'subtitle_off') {

onSubtitleOff()

}

},

onStateChange,

onMessage: async (error: any) => {

// 处理错误消息

}

}

// 创建SDK实例

const avatar = new window.XmovAvatar(constructorOptions)

// 等待初始化

await new Promise(resolve => {

setTimeout(resolve, APP_CONFIG.AVATAR_INIT_TIMEOUT)

})

// 初始化SDK

await avatar.init({

onDownloadProgress: (progress: number) => {

console.log(`初始化进度: ${progress}%`)

if (progress >= 100) {

resolve(true)

}

},

onClose: () => {

onStateChange('')

console.log('SDK连接关闭')

}

})

return avatar

}

发送信息:

项目在 src/stores/app.ts 中管理应用状态和业务逻辑:

/**

* 连接虚拟人

* @returns {Promise<void>} - 返回连接结果的Promise

* @throws {Error} - 当appId或appSecret为空或连接失败时抛出错误

*/

// 连接虚拟人

async connectAvatar(): Promise<void> {

const { appId, appSecret } = appState.avatar

if (!validateConfig({ appId, appSecret }, ['appId', 'appSecret'])) {

throw new Error('appId 或 appSecret 为空')

}

try {

const avatar = await avatarService.connect({

appId,

appSecret

}, {

onSubtitleOn: (text: string) => {

appState.ui.subTitleText = text

},

onSubtitleOff: () => {

appState.ui.subTitleText = ''

},

onStateChange: (state: string) => {

avatarState.value = state

}

})

appState.avatar.instance = avatar

appState.avatar.connected = true

} catch (error) {

appState.avatar.connected = false

throw error

}

}

/**

* 发送消息到LLM并让虚拟人播报

* @returns {Promise<string | undefined>} - 返回大语言模型的回复内容,失败时返回undefined

* @throws {Error} - 当发送消息失败时抛出错误

*/

// 发送消息

async sendMessage(): Promise<string | undefined> {

const { llm, ui, avatar } = appState

if (!validateConfig(llm, ['apiKey']) || !ui.text || !avatar.instance) {

return

}

try {

// 发送到LLM获取回复

const stream = await llmService.sendMessageWithStream({

provider: 'openai',

model: llm.model,

apiKey: llm.apiKey

}, ui.text)

if (!stream) return

// 等待虚拟人停止说话

await this.waitForAvatarReady()

// 流式播报响应内容

let buffer = ''

let isFirstChunk = true

for await (const chunk of stream) {

buffer += chunk

const arr = splitSentence(buffer)

if(arr.length > 1) {

const ssml = generateSSML(arr[0] || '')

if (isFirstChunk) {

// 第一句话:ssml true false

avatar.instance.speak(ssml, true, false)

isFirstChunk = false

} else {

// 中间的话:ssml false false

avatar.instance.speak(ssml, false, false)

}

buffer = arr[1] || ''

}

}

// 处理剩余的字符

if (buffer.length > 0) {

const ssml = generateSSML(buffer[0])

if (isFirstChunk) {

// 第一句话:ssml true false

avatar.instance.speak(ssml, true, false)

} else {

// 中间的话:ssml false false

avatar.instance.speak(ssml, false, false)

}

}

// 最后一句话:ssml false true

const finalSsml = generateSSML('')

avatar.instance.speak(finalSsml, false, true)

return buffer

} catch (error) {

console.error('发送消息失败:', error)

throw error

}

}

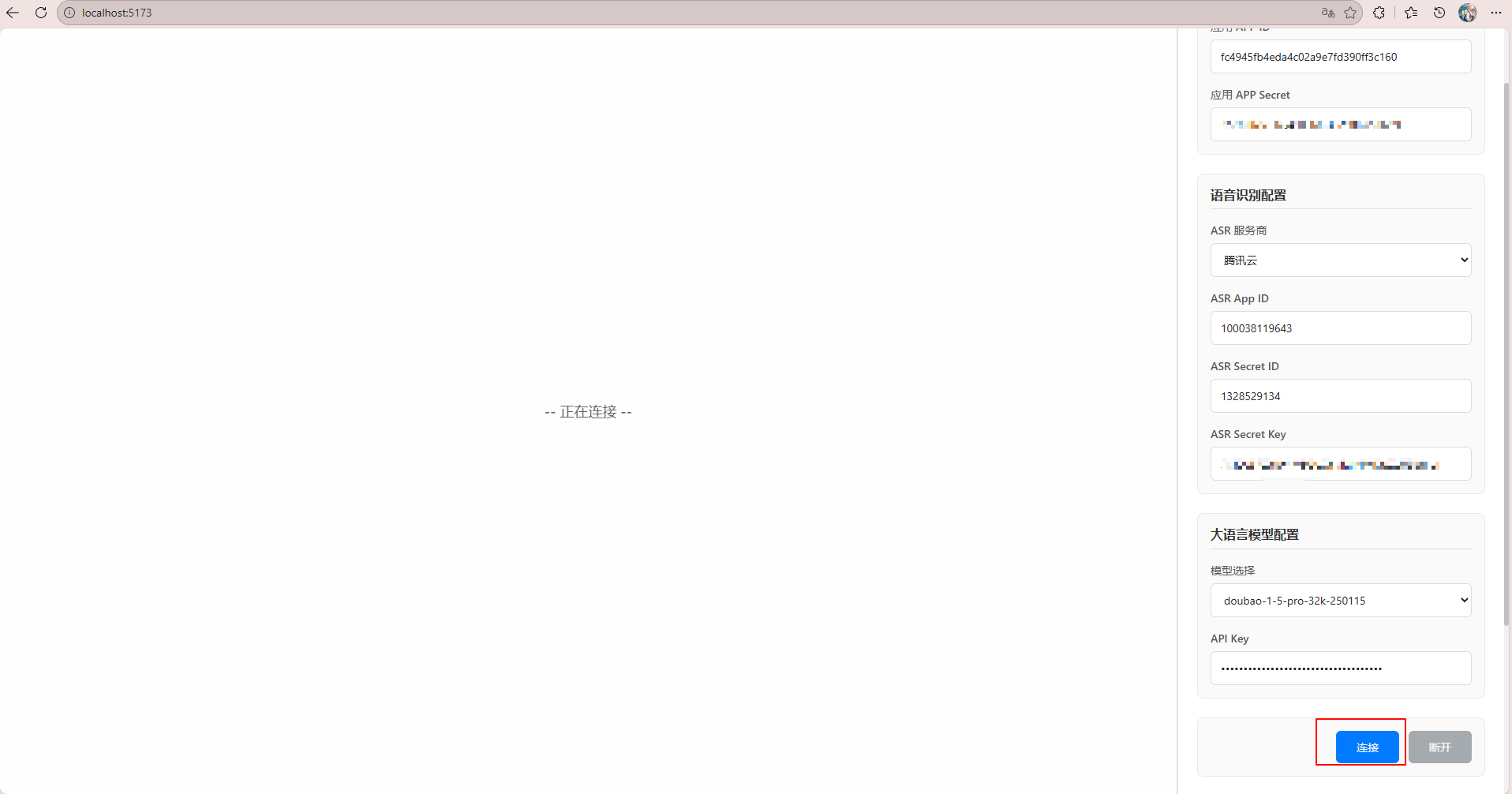

3.5 SDK 配置:关键参数的对接与调试

在配置界面获取 App ID 和 App Secret。

3.6 能力接入:语音识别 + 大模型的交互链路打通

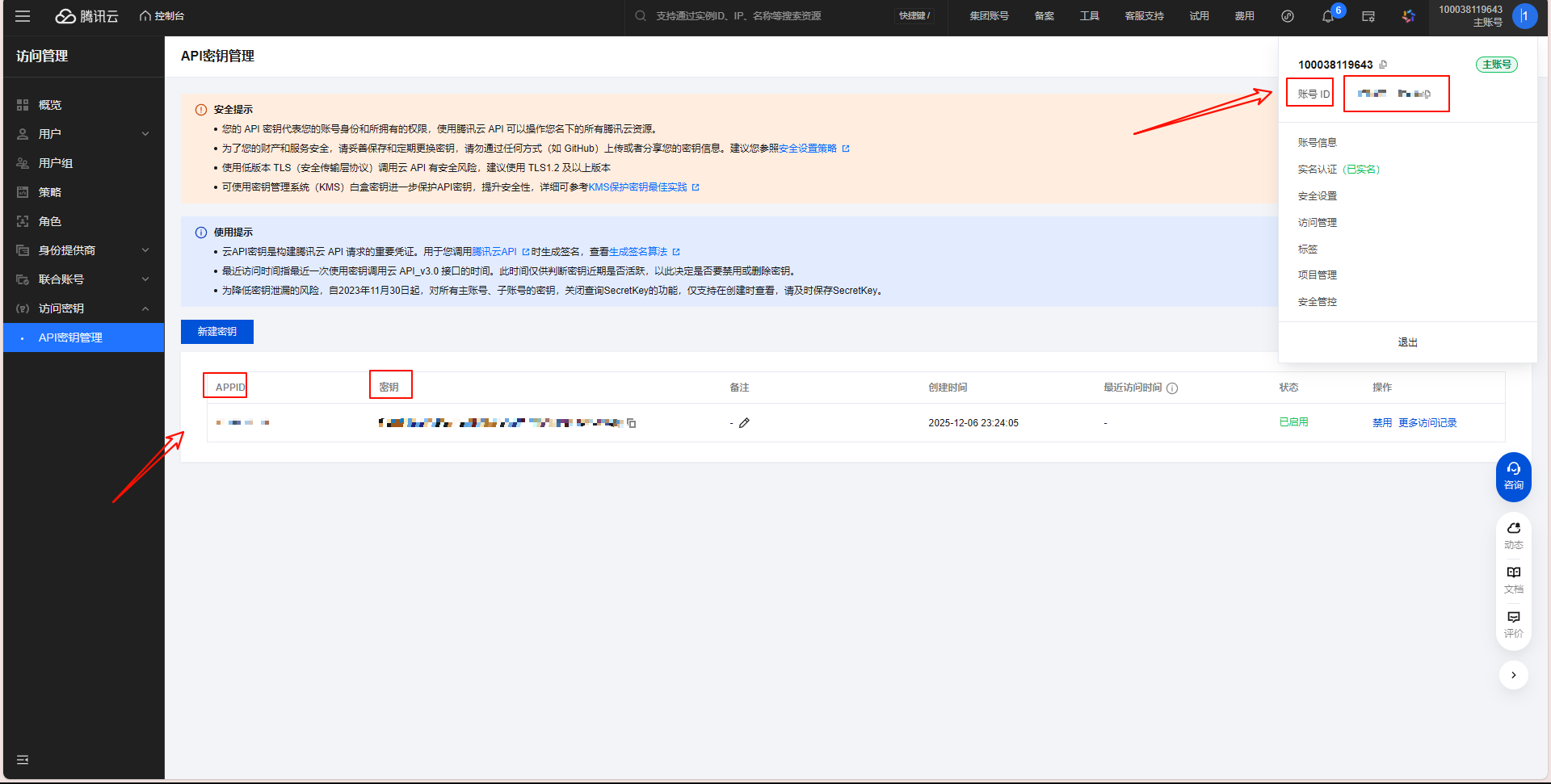

在腾讯云ASR获取 App ID、Secret ID、Secret Key。

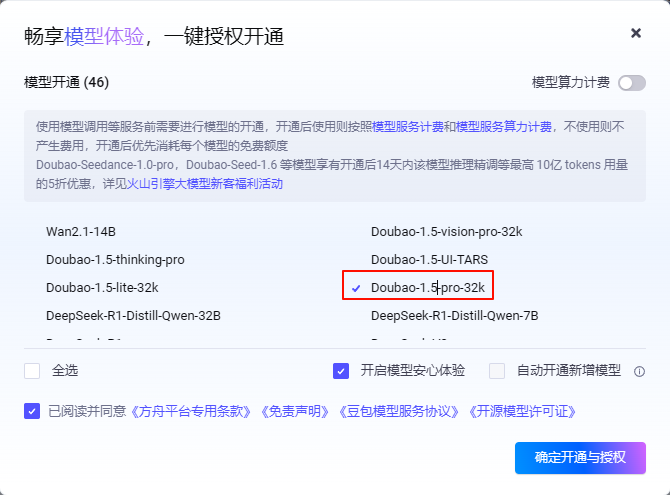

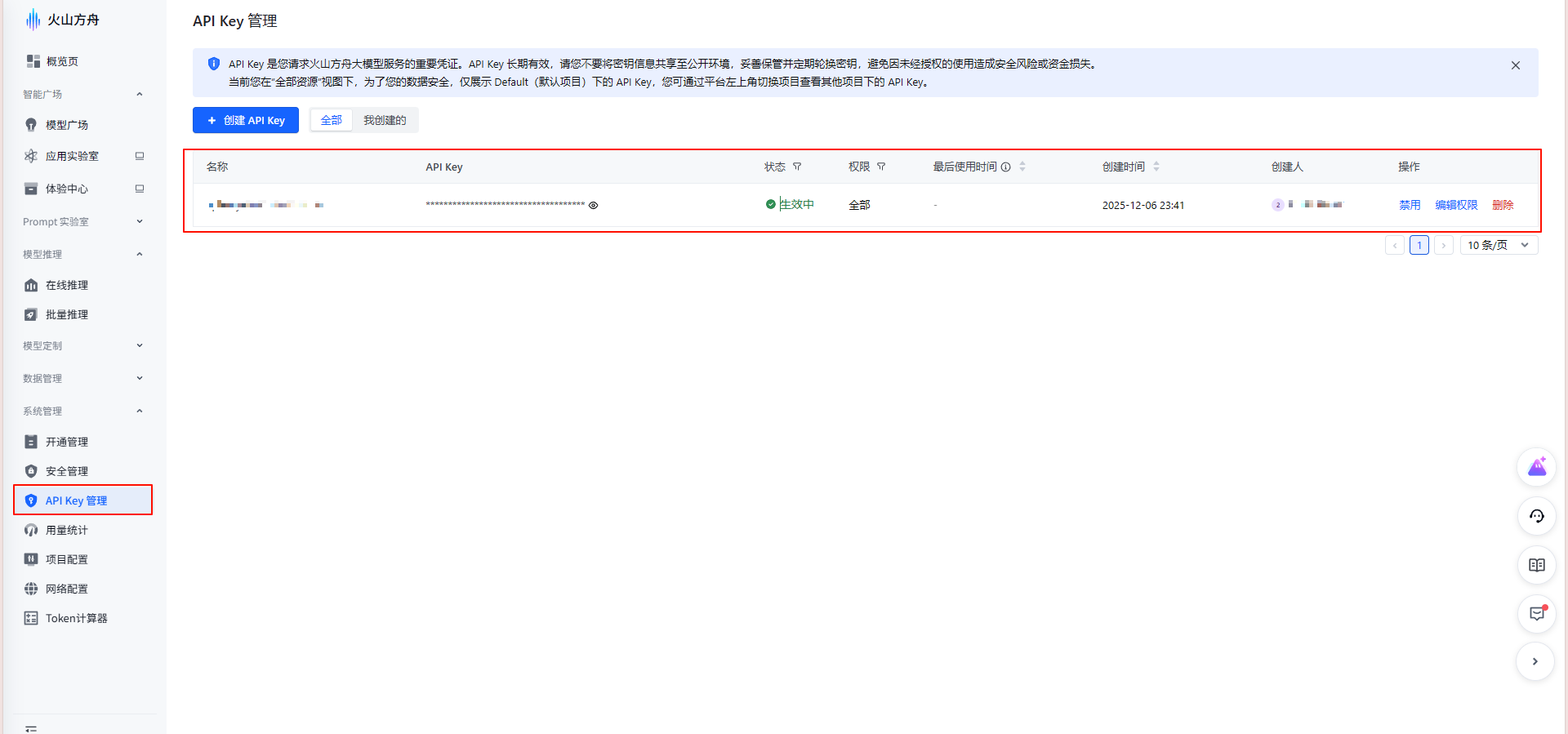

在火山引擎获取大模型 API Key:选择模型为 doubao-1-5-pro-32K-250115(可根据实际需求灵活切换),按照界面指引完成配置后,即可获取对应的 API Key。

3.7 实战演示:“AI 导览助手” 的多模态交互效果

完成 API Key 配置后,点击界面 “连接” 按钮,即可启动 “AI 导览助手” 的交互功能。

效果展示中,数字人会以多模态形式完成导览交互:输入导览指令后,它不仅能同步输出语音讲解,还会配合对应的表情与肢体动作(如介绍内容时的手势指向),让导览过程更生动、更具场景代入感。

PixPin_2025-12-07_00-44-45

本 Demo 项目的完整源码可在官方文档里下载,下载完成后,即可参照前文的操作步骤复现整个流程,实际体验魔珐星云 SDK 的运行效果,相信大家能获得良好的实践体验。

四、应用场景:具身智能的多元落地方向

4.1 大模型 “具身化”:从文字 AI 到可交互数字形象

魔珐星云推动大模型跳出文字交互局限,将主流大模型的智能能力与 3D 数字人深度绑定。数字人凭借 180 + 面部控制点驱动的微表情与肢体动作,让 AI 从冰冷对话框升级为有温度的交互伙伴,在教育科普、心理咨询等场景中实现情感化沟通。这种 “智能大脑 + 实体载体” 的模式,完成了从 “有问必答” 到 “有感而应” 的体验跨越。

4.2 公共服务:24/7 数字人服务屏的低成本落地

依托无 GPU 运行的技术优势,魔珐星云大幅降低公共服务场景的部署门槛,百元级芯片即可支撑数字人稳定运行。数字人可 7×24 小时在线,精准解答政策咨询、流程指引等高频需求,将办事时长缩短 80%,适配政务大厅、医院、车站等多场景。其多终端适配能力还实现线下实体屏与线上平台的服务联动,构建全时段智能服务网络。

4.3 商业 IP:虚拟角色与游戏 NPC 的交互升级

魔珐星云的实时交互技术让虚拟 IP 与游戏 NPC 摆脱预录脚本限制,能根据用户互动实时调整话术与动作。超写实、二次元等多风格数字人库可精准匹配品牌调性,虚拟偶像能与粉丝自然对话,游戏 NPC 可自主响应玩家行为,显著提升用户沉浸感与粘性。这种升级让虚拟 IP 从流量符号转变为可沉淀情感价值的核心资产。

4.4 个人开发:创意应用的自主搭建空间

魔珐星云通过标准化 SDK 与免费开放资源,让个人开发者无需专业建模或算法知识即可涉足具身智能领域。开发者通过简单参数配置,就能快速搭建 AR 导览、虚拟陪伴等创意应用,平台提供的详细文档与社区支持,进一步降低开发难度。低成本与高易用性的结合,让个人创意能高效转化为实际应用,成为行业创新的重要力量。

五、总结与资源:让具身智能人人可及

5.1 测评结语:魔珐星云的 “平民化” 价值

过去具身智能与 3D 数字人是大企业专属,高成本、高技术门槛让中小团队与个人望而却步。而魔珐星云通过无 GPU 运行、标准化 SDK 等能力,彻底打穿了技术与成本壁垒 —— 无需专业团队、不用昂贵硬件,中小企业能低成本部署数字人服务,个人开发者也能落地创意项目。这种 “平民化” 价值,真正让具身智能从高端实验室走向了日常应用场景。

5.2 开发者福利:免费 SDK 与额度权益解读

魔珐星云向所有开发者免费开放基础版 SDK,核心的数字人驱动、语音交互等功能无需付费即可调用。新用户注册后会获得基础使用额度,通过平台邀请码注册还能扩容额度,足以覆盖开发测试阶段的需求。这些福利大幅降低了开发者的试错成本,让大家能轻量启动具身智能项目,快速验证创意落地的可行性。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)