AI代码开发宝库系列:LoRA微调艺术

LoRA(Low-Rank Adaptation)微调是近年来在大模型领域掀起的一场革命!想象一下,你要训练一个70亿参数的大模型,传统方法需要数千万元的算力成本,而LoRA只需要更新其中1-10%的参数,成本瞬间降低10倍!LoRA微调技术的出现,让大模型的应用门槛大大降低。无论是个人开发者还是企业用户,都可以通过这项技术快速构建专业领域的AI助手。随着技术的不断发展,我们有理由相信,未来的AI

LoRA微调艺术:让你的大模型秒变专业助手的黑科技!

大家好,我是你们的AI技术博主!今天要给大家揭秘一项让大模型"脱胎换骨"的神奇技术——LoRA微调!这项技术能让你的通用大模型瞬间变成医疗专家、法律顾问、甚至是你的私人助理,简直就是AI领域的"点石成金"术!

一、什么是LoRA微调?为什么它如此重要?

LoRA(Low-Rank Adaptation)微调是近年来在大模型领域掀起的一场革命!想象一下,你要训练一个70亿参数的大模型,传统方法需要数千万元的算力成本,而LoRA只需要更新其中1-10%的参数,成本瞬间降低10倍!

LoRA的核心原理:低秩矩阵分解

这听起来很高大上,但其实原理很简单。就像你要记住一个人的特征,不需要记住他每一根头发的颜色,只需要记住几个关键特征(比如眼睛、鼻子、嘴巴)就够了。LoRA就是这个道理,它发现大模型在微调时,真正重要的参数变化只集中在少数几个维度上。

二、LoRA vs 其他微调方法:谁是真正的王者?

| 方法 | 训练参数比例 | 显存需求 | 适用场景 |

|---|---|---|---|

| 全参数微调 | 100% | 巨大 | 大厂专属 |

| Prompt Tuning | <0.01% | 极小 | 简单任务 |

| LoRA | 1-10% | 中等 | 万能选手 |

| QLoRA | 1-10% | 极小 | 消费级显卡 |

结论:LoRA是性价比之王!

三、LoRA技术深度解析

1. 核心思想:旁路机制

# 传统微调:直接修改原有权重W h = (W + ΔW) * x # LoRA微调:冻结W,训练旁路矩阵A和B h = W * x + B * A * x

这就是LoRA的精髓!不改动原模型,只训练一个小的旁路网络,既保证了效果,又大大降低了成本。

2. 数学原理:矩阵分解

LoRA基于一个重要的数学发现:权重更新矩阵ΔW具有低秩特性。通过奇异值分解(SVD),我们可以用两个小矩阵A和B来近似表示ΔW:

ΔW ≈ B * A 其中A是降维矩阵,B是升维矩阵

文档核心是围绕大模型高效微调展开,重点讲解 LoRA 技术原理、数据准备、硬件需求及模型评估,同时对比不同微调方法与应用场景,为开发者提供从技术选型到落地的完整指南。

一、微调核心认知与分类

1. 微调的定位:解决什么问题

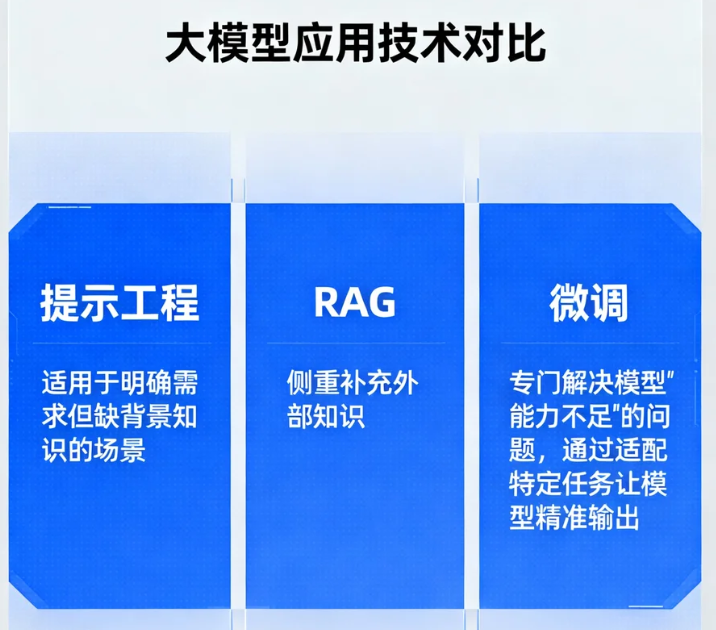

大模型应用中,提示工程适用于明确需求但缺背景知识的场景,RAG 侧重补充外部知识,而微调专门解决模型 “能力不足” 的问题,通过适配特定任务让模型精准输出。

2. 两类微调的核心差异

| 主体 | 目标 | 规模与成本 | 技术手段 | 交付形式 |

|---|---|---|---|---|

| 基座模型公司(OpenAI、阿里等) | 提升通用语言能力 | 100B + 参数,千卡月级成本 | 继续预训练 + 指令微调 + RLHF/PPO/DPO | 公开权重或 API |

| 应用开发者(企业 / 个人) | 适配垂直领域 / 私域知识(医疗、客服等) | 6B–70B 参数,数小时~数天 | LoRA/QLoRA 为主 | 几十 MB 的增量 LoRA 权重(可热插拔) |

3. 主流高效微调方法对比

-

Prompt Tuning:训练量 <0.01%,仅优化输入层 “软提示” 向量,仅 10B + 大模型效果较好,场景受限。

-

P-Tuning v1/v2:训练量 0.1%~1%,在每一层插入 “软提示” 向量,NLU 任务(分类、阅读理解)表现优于 Prompt Tuning,中小模型也适用。

-

Prefix Tuning:训练量 0.1%~3%,通过 MLP 生成 “隐式前缀 token” 并冻结,适配 NLG 任务(对话、摘要、翻译)。

-

LoRA:训练量 1%~10%,核心是低秩更新,冻结原模型权重,通过两个小矩阵近似权重更新,通用型强,支持 LLM 和扩散模型。

-

QLoRA:LoRA 的量化版本,先将模型量化为 4-bit,内存占用极低,适合单张消费级显卡微调大模型(如 65B)。

二、LoRA 核心原理

1. 核心假设:权重更新的低秩特性

大模型微调时,权重更新量 ΔW 看似是高维矩阵,但有效变化集中在少数维度,具有 “内在低秩特性”—— 通过 SVD 分解可见,ΔW 的奇异值快速衰减,大部分冗余信息可忽略。

2. 技术思路:不碰原权重,训练 “旁路”

-

冻结预训练模型的原始权重矩阵 W,新增两个低秩小矩阵 A(降维)和 B(升维)。

-

前向传播公式:h=W**x+BAx,其中 BA 近似等价于 ΔW,即权重更新量。

-

训练仅更新 A 和 B,推理时将 BA 合并到 W 中,无额外延迟。

-

初始化:A 用高斯分布,B 初始化为全 0,确保训练初期旁路不影响原模型。

3. 低秩特性通俗理解

高秩矩阵类似无规律的 1000x1000 表格,需保存全部数据;低秩矩阵数据高度相关(如所有行都是第一行的倍数),仅需保存少量基础数据即可重建全貌。类比全球气温报告,无需保存每个城市每分钟数据,通过 “纬度”“季节” 等核心因素就能推测气温。

三、矩阵分解:LoRA 的数学基础

1. 核心用途

将高维矩阵拆解为低维用户矩阵和物品矩阵,用于预测缺失值(如推荐系统中的用户 - 商品评分)。

2. 推荐系统中的应用逻辑

-

已知用户 - 商品评分矩阵 R,通过矩阵分解得到用户向量 X 和物品向量 Y。

-

用户 u 对商品 i 的预测评分 = X_u 与 Y_i 的内积,评分越高越值得推荐。

-

目标函数:最小化预测评分与真实评分的误差,加入 L2 正则项防止过拟合。

3. 求解方法

-

ALS(交替最小二乘法):固定 Y 优化 X,再固定 X 优化 Y,重复至收敛。

-

SGD(随机梯度下降):通过迭代调整参数减小误差。

4. SVD 奇异值分解

-

公式:A=PΛQ**T,其中 P 为左奇异矩阵(用户矩阵),Q 为右奇异矩阵(物品矩阵),Λ 为奇异值矩阵。

-

作用:保留前 K 个最大奇异值可实现矩阵压缩,既减少计算量,又能保留核心信息(如图片压缩、推荐系统降维)。

四、微调数据准备:高质量是关键

1. 数据核心要求

-

一致性:所有数据遵循统一模板(如

<指令>{instruction}</指令> <输入>{input}</输入> <回复>{response}</回复>),避免指令风格混乱。 -

准确性:答案必须正确,模型会学习数据中的所有模式(包括错误),即 “垃圾进垃圾出”。

-

多样性:覆盖任务各类场景,提升模型泛化能力。

2. 数据量与模型 / 场景的匹配

| 模型规模 | 任务场景 | 建议数据量(指令 - 回复对) | 说明 |

|---|---|---|---|

| ~7B | 简单任务(风格模仿、简单问答) | 1000-5000 条 | 模型已有基础能力,微调仅需 “引导校准” |

| ~7B | 复杂任务(推理、专业领域) | 5000-50000 + 条 | 复杂逻辑需更多样本支撑 |

| ~13B~70B | 通用 / 复杂任务 | 1 万 - 10 万 + 条 | 模型容量大,可学习更细微模式 |

| >70B | 继续预训练 | GB 级别文本 | 目标是学习语言本身,需海量语料 |

3. 数据准备步骤

-

聚焦质量:80% 时间用于清洗、格式统一和答案校验,1000 条高质量数据优于 10 万条杂乱数据。

-

评估数量:从小规模(如 1000 条)起步,若模型欠拟合再增量添加,1000-6000 条是多数任务的 “黄金起点”。

五、硬件需求与显存估算

1. 显存占用构成

总显存≈模型权重显存 + 优化器状态显存 + 梯度显存 + 前向传播激活值显存。

-

模型权重显存:FP16/BF16 格式下,参数量(B)×2 字节(如 7B 模型≈14GB)。

-

优化器状态显存(AdamW):可训练参数量 L×4 字节 ×2(两个状态)。

-

梯度显存:L×2 字节。

-

激活值显存:约为模型权重显存的 20%-50%,与批次大小、序列长度相关。

2. 典型模型显存估算(LoRA 方案)

-

7B 模型:总显存≈14GB(权重)+0.56GB(优化器)+0.14GB(梯度)+4.2GB(激活值)≈19GB,24GB 显卡(如 RTX4090)可流畅运行。

-

13B 模型:权重显存≈26GB,需 32GB 以上显卡或 QLoRA。

-

70B 模型:必须用 QLoRA + 多卡部署。

3. QLoRA 的优势

将模型权重量化到 4-bit,权重显存降至参数量 ×0.5 字节,7B 模型仅需 6-8GB 显存,普通显卡即可支持。

4. 硬件选择建议

-

7B/8B 模型:24GB 显存(3090/4090)。

-

13B/14B 模型:32GB + 显存(V100/A100)或 QLoRA。

-

70B 模型:QLoRA + 多卡。

六、微调后模型评估:多维度验证效果

1. 数据集划分

-

训练集:用于更新模型权重。

-

验证集:训练中监控表现、调整超参数,不用于最终报告。

-

测试集:一次性最终评估,全程 “封存”,避免数据泄露。

2. 核心评估维度

| 维度 | 测试内容 | 说明 |

|---|---|---|

| 任务主指标 | 分类(准确率、F1)、生成(BLEU、ROUGE)、问答(EM、F1) | 量化模型在目标任务上的提升幅度 |

| 通用能力保持 | 常识推理、基础代码、通用对话 | 防止 “灾难性遗忘”,避免模型因学新任务丢失原有能力 |

| 泛化能力 | 不同表述、复杂场景的任务输入 | 检验模型是 “死记硬背” 还是真正 “学会” 任务 |

| 人工评估 | 流畅度、相关性、有用性 | 衡量自动化指标无法捕捉的生成质量(如对话、创意写作) |

| 输出质量分析 | 正面 / 失败案例对比 | 直观理解模型变化,为迭代提供方向 |

3. 评估流程

-

训练后用测试集对比基座模型与微调模型的主指标。

-

进行通用能力和泛化能力测试。

-

人工抽查样本输出,分析质量。

-

综合判断:主指标提升且通用能力无退化,即为成功微调。

七、PEFT 库:高效微调工具支持

PEFT 库(Hugging Face 开源)可快速将 HF 模型转换为轻量级微调模型,支持 5 种主流策略:LoRA、Prefix Tuning、P-Tuning、Prompt Tuning、AdaloRA,无需手动搭建复杂架构,且能与 DeepSpeed 等大模型加速工具无缝集成。

要不要我帮你整理一份LoRA 微调实操步骤清单,涵盖数据准备、显存配置、评估指标选择等关键环节,方便直接落地使用?

LoRA 微调实操步骤清单(全流程落地版)

一、前期准备:明确目标与选型

1. 确定任务场景与模型

-

明确微调目标:是 NLU 任务(如医疗文本分类、法律阅读理解)还是 NLG 任务(如客服对话生成、产品摘要撰写),参考文档中 P-Tuning 适配 NLU、Prefix Tuning 适配 NLG 的特性,优先选择 LoRA(通用型最佳)。

-

选定基座模型:根据硬件资源选择,24GB 显存优先 7B 模型(如 Llama 3-8B、Qwen-7B),32GB 显存可尝试 13B 模型(如 Llama 3-13B),显存 < 16GB 需用 QLoRA+7B 模型(如 Phi-2-2.7B)。

2. 工具栈搭建

-

核心库安装:

transformers(加载预训练模型)、peft(实现 LoRA)、bitsandbytes(4-bit 量化,QLoRA 必装)、datasets(数据处理)、accelerate(分布式训练适配)。 -

硬件检查:用

nvidia-smi查看显卡显存,确保空闲显存≥估算值(7B 模型 LoRA 微调需≥19GB,QLoRA 需≥8GB)。

二、数据准备:80% 精力投入,确保高质量

1. 数据收集与筛选

-

来源:私域数据(如企业历史客服记录)、公开数据集(如医疗领域 MIMIC-III、金融领域 FiQA),避免使用低质量爬取数据(易引入错误 pattern)。

-

筛选标准:剔除重复数据(如相同指令 - 回复对)、无效数据(如回复为空 / 与指令无关),保留与任务强相关的样本(如微调 “电商售后对话”,仅保留退款、物流相关数据)。

2. 数据格式标准化

-

统一模板:严格遵循

<指令>{instruction}</指令> <输入>{input}</输入> <回复>{response}</回复>格式,示例:

-

指令:“解答用户的电商退款疑问”

-

输入:“我昨天买的衣服不合适,怎么申请退款?”

-

回复:“您好,可在【我的订单】找到对应商品,点击【申请售后】选择【退款】,上传商品照片后等待审核,审核通过后 1-3 个工作日到账。”

-

-

避免格式混乱:若任务无 “输入”(如风格模仿:“用古风写一首中秋诗”),可保留

<输入></输入>空字段,不随意修改模板结构。

3. 数据清洗与校验

-

准确性校验:人工抽查 30% 样本,确保回复无事实错误(如医疗数据需核对病症对应治疗建议,金融数据需确认利率计算正确),符合 “garbage in garbage out” 原则。

-

多样性补充:若样本集中某类子任务占比过高(如售后数据中 “退款” 占 80%、“物流” 仅占 5%),需补充低占比子任务样本,避免模型偏科。

-

划分数据集:按 7:1:2 比例拆分训练集、验证集、测试集,测试集需 “严格封存”,不用于训练过程中的任何调参(如验证集可调整学习率,测试集仅最终评估用)。

4. 数据量适配

-

参考文档标准:7B 模型简单任务(如产品标题生成)用 1000-5000 条,复杂任务(如法律合同解析)用 5000-50000 条;13B 模型通用任务需 1 万 - 10 万条。

-

最小验证:若数据量有限,可先从 1000 条高质量样本起步,训练 1-2 轮后观察验证集损失,若损失持续下降且无过拟合(验证集损失不上升),再逐步增量数据。

三、显存配置:精准估算与优化

1. 显存需求估算(按文档公式)

-

基础公式:总显存≈模型权重显存 + 优化器状态显存 + 梯度显存 + 激活值显存

-

模型权重显存(FP16):参数量(B)×2 字节(如 7B 模型≈14GB,13B 模型≈26GB)

-

优化器状态显存(AdamW):LoRA 可训练参数量(L)×8 字节(L = 模型总参数量 ×1%~10%,7B 模型取 1% 则 L=7e7,显存≈0.56GB)

-

梯度显存:L×2 字节(7B 模型≈0.14GB)

-

激活值显存:模型权重显存 ×30%(7B 模型≈4.2GB)

-

-

实例:7B 模型 LoRA 微调总显存≈14+0.56+0.14+4.2=19GB,24GB 显卡(RTX4090)可预留 5GB 空闲空间,避免显存溢出。

2. 显存优化策略

-

启用 4-bit 量化(QLoRA):若显存不足(如 16GB 显卡),用

bitsandbytes将模型量化为 4-bit,权重显存降至参数量 ×0.5 字节(7B 模型≈3.5GB),总显存可压缩至 8-10GB。 -

调整训练参数:

-

批次大小(batch size):初始设为 1,若显存剩余≥5GB,可逐步增至 2(需用

gradient_accumulation_steps=2 等效提升批次,避免单次显存占用过高)。 -

序列长度(sequence length):根据任务设定(如对话任务设 512,长文本摘要设 1024),不盲目增大(每增加 1 倍长度,激活值显存约增加 50%)。

-

-

关闭冗余功能:训练时禁用

wandb实时日志(非必要),用torch.cuda.empty_cache()定期清理无用缓存,避免显存碎片。

四、LoRA 参数配置(核心环节)

1. 关键参数设置(参考文档最佳实践)

| 参数 | 作用 | 推荐值(7B 模型) | 说明 |

|---|---|---|---|

r(秩) |

控制低秩矩阵维度 | 4-8(简单任务)、16-32(复杂任务) | 秩越高可捕捉模式越复杂,但显存占用增加,文档建议一般任务 r=1-8 即可 |

lora_alpha |

缩放因子,控制 LoRA 更新幅度 | r×2(如 r=8 时设 16) |

平衡更新强度,避免过拟合或欠拟合 |

lora_dropout |

dropout 概率,防止过拟合 | 0.05-0.1 | 数据量 < 5000 条时建议启用,≥1 万条可设 0 |

target_modules |

需微调的模型层(如注意力层) | 7B 模型:q_proj, v_proj(Llama 系列) |

仅微调注意力层即可覆盖多数任务,减少计算量 |

bias |

是否训练偏置参数 | "none"(不训练) | 训练偏置会增加显存占用,且对效果提升有限 |

2. 初始化与训练设置

-

权重初始化:A 矩阵用高斯分布(

torch.randn),B 矩阵初始化为全 0(确保训练初期不干扰原模型),通过peft.LoraConfig自动实现。 -

优化器与学习率:

-

优化器:AdamW(文档常用),权重衰减(

weight_decay)设 0.01,防止过拟合。 -

学习率:1e-4~5e-4(7B 模型),用

CosineAnnealingLR学习率调度,训练后期逐步衰减。

-

-

训练轮次(epochs):数据量 1000 条设 3-5 轮,5000 条设 2-3 轮,避免过拟合(验证集损失上升时提前停止)。

五、训练过程监控与调优

1. 实时监控指标

-

核心指标:训练集损失(需稳步下降)、验证集损失(若连续 2 轮上升,触发早停)、任务主指标(如分类任务的 F1 分数,需同步上升)。

-

显存监控:每轮训练后用

nvidia-smi查看显存占用,若出现 “CUDA out of memory”,立即降低 batch size 或启用 QLoRA。

2. 常见问题处理

-

过拟合:训练集损失持续下降但验证集损失上升,解决方案:①增加

lora_dropout至 0.1;②减少训练轮次;③补充 500-1000 条多样性数据。 -

欠拟合:训练集与验证集损失均居高不下,解决方案:①提高学习率至 5e-4;②增大

r(如从 8 增至 16);③检查数据是否存在格式错误或标签错误。 -

训练中断:用

peft的save_pretrained定期保存 LoRA 权重(每轮保存 1 个 checkpoint),中断后通过peft.LoraModel.from_pretrained加载继续训练。

六、模型评估:多维度验证效果

1. 测试集量化评估(必做)

-

按任务选择指标(参考文档):

-

NLU 任务:分类用 “准确率 + F1 分数”(二分类用 F1,多分类用宏 F1),阅读理解用 “EM(精确匹配)+F1”。

-

NLG 任务:摘要用 “ROUGE-1/2/L”,翻译用 “BLEU”,对话用 “Distinct-1/2”(衡量多样性)。

-

-

对比基准:同时运行基座模型与 LoRA 微调模型,若微调后主指标提升≥5%(如分类 F1 从 70% 升至 75%),说明微调有效。

2. 通用能力与泛化能力测试

-

通用能力测试:设计 10-20 个常识 / 基础任务样本,如 “西瓜的籽是什么颜色?”“写一个 Python 冒泡排序代码”,若微调后回复准确率下降≤10%,说明无 “灾难性遗忘”。

-

泛化能力测试:构造与训练数据 “句式不同但意图相同” 的样本,如训练数据是 “怎么退差价?”,测试样本用 “下单后商品降价,差价怎么返还?”,若回复准确率≥80%,说明模型真正学会任务(非死记硬背)。

3. 人工评估(关键任务必做)

-

抽样规则:从测试集中随机抽取 50-100 条样本,按 “流畅度、相关性、有用性” 三维度打分(1-5 分),平均得分≥4 分视为合格。

-

评分标准:

-

流畅度:无语法错误、语句通顺(如 “退款流程是点击申请售后然后等”→不流畅,需补充完整)。

-

相关性:回复紧扣指令,不偏离主题(如用户问 “物流”,回复不涉及 “商品质量”)。

-

有用性:能解决用户问题(如售后回复需包含 “操作步骤 + 时效”,而非仅说 “可以退款”)。

-

七、模型部署与迭代

1. 权重保存与加载

-

保存:仅保存 LoRA 增量权重(

peft_model.save_pretrained("lora_weights")),文件大小约几十 MB(7B 模型 r=8 时约 30MB),可快速迁移。 -

加载:部署时加载基座模型 + LoRA 权重(

PeftModel.from_pretrained(base_model, "lora_weights")),推理时合并权重(peft_model.merge_and_unload()),无额外延迟。

2. 任务切换与迭代

-

多任务切换:若需适配新任务(如从 “电商售后” 切换到 “家电维修咨询”),无需重新训练基座模型,仅需减掉原 LoRA 权重(

peft_model.delete_adapter("old_lora")),训练新任务的 LoRA 权重即可。 -

持续迭代:收集部署后用户反馈的 “错误案例”(如回复错误、不相关),补充到训练集中,每 1-2 周重新微调一次,逐步提升模型效果。

八、风险规避与注意事项

-

数据合规:确保使用的数据无版权问题(如私域数据需获得用户授权),避免涉及敏感信息(如医疗数据需脱敏,去除姓名、身份证号)。

-

显存预留:训练前关闭其他占用显存的程序(如浏览器、其他模型服务),预留 10%-20% 显存作为缓冲,防止突发显存溢出。

-

超参调试:建议用 “控制变量法” 调试参数(如固定其他参数,仅调整

r从 4→8→16),避免同时修改多个参数导致无法定位效果变化原因。

实战案例:医疗问答系统微调

让我们通过一个实际案例来看看LoRA的强大之处!

数据准备:构建医疗问答数据集

import pandas as pd

from datasets import Dataset

# 医疗问答数据示例

medical_data = [

{

"instruction": "请回答以下医疗相关问题",

"input": "我最近总是感觉头晕,应该怎么办?",

"output": "头晕可能由多种原因引起,包括血压异常、贫血、颈椎病等。建议您:1. 测量血压;2. 检查血常规;3. 如症状持续,请及时就医。"

},

{

"instruction": "请回答以下医疗相关问题",

"input": "感冒发烧应该吃什么药?",

"output": "感冒发烧时,可以考虑:1. 对乙酰氨基酚退烧;2. 多喝温水;3. 充分休息。如高烧不退或症状加重,请及时就医。"

}

]

# 转换为Dataset格式

dataset = Dataset.from_list(medical_data)

模型微调完整代码

#!/usr/bin/env python

# -*- coding: utf-8 -*-

from unsloth import FastLanguageModel

import torch

from datasets import Dataset

from trl import SFTTrainer

from transformers import TrainingArguments

# 1. 加载预训练模型

model, tokenizer = FastLanguageModel.from_pretrained(

model_name="Qwen2.5-7B", # 使用Qwen2.5-7B模型

max_seq_length=2048,

dtype=None,

load_in_4bit=True, # 4bit量化节省显存

)

# 2. 添加LoRA适配器

model = FastLanguageModel.get_peft_model(

model,

r=16, # LoRA秩

target_modules=["q_proj", "k_proj", "v_proj", "o_proj",

"gate_proj", "up_proj", "down_proj"],

lora_alpha=16,

lora_dropout=0,

bias="none",

use_gradient_checkpointing="unsloth",

random_state=3407,

)

# 3. 数据格式化

medical_prompt = """你是一个专业的医疗助手。请根据患者的问题提供专业、准确的回答。

### 问题:

{}

### 回答:

{}"""

EOS_TOKEN = tokenizer.eos_token

def formatting_prompts_func(examples):

inputs = examples["input"]

outputs = examples["output"]

texts = []

for input, output in zip(inputs, outputs):

text = medical_prompt.format(input, output) + EOS_TOKEN

texts.append(text)

return {"text": texts}

# 应用格式化函数

dataset = dataset.map(formatting_prompts_func, batched=True)

# 4. 设置训练参数

training_args = TrainingArguments(

per_device_train_batch_size=2,

gradient_accumulation_steps=4,

warmup_steps=5,

max_steps=60,

learning_rate=2e-4,

fp16=not torch.cuda.is_bfloat16_supported(),

bf16=torch.cuda.is_bfloat16_supported(),

logging_steps=1,

optim="adamw_8bit",

weight_decay=0.01,

lr_scheduler_type="linear",

seed=3407,

output_dir="outputs",

report_to="none",

)

# 5. 创建训练器

trainer = SFTTrainer(

model=model,

tokenizer=tokenizer,

train_dataset=dataset,

dataset_text_field="text",

max_seq_length=2048,

dataset_num_proc=2,

packing=False,

args=training_args,

)

# 6. 开始训练

trainer_stats = trainer.train()

# 7. 模型推理测试

def generate_medical_response(question):

FastLanguageModel.for_inference(model)

inputs = tokenizer(

[medical_prompt.format(question, "")],

return_tensors="pt"

).to("cuda")

from transformers import TextStreamer

text_streamer = TextStreamer(tokenizer)

_ = model.generate(

**inputs,

streamer=text_streamer,

max_new_tokens=256,

temperature=0.7,

top_p=0.9,

)

# 测试

generate_medical_response("我最近总是感觉头晕,应该怎么办?")

未来应用场景展望

1. 垂直领域专家系统

-

医疗助手:问诊、用药指导、健康咨询

-

法律咨询:合同审查、法律条文解释

-

教育辅导:个性化教学、作业批改

2. 企业级应用

-

客服系统:智能客服、工单处理

-

数据分析:商业报告生成、趋势预测

-

内容创作:营销文案、产品描述

3. 个人化AI助手

-

生活助手:日程管理、购物建议

-

学习伙伴:语言学习、技能培训

-

创意伙伴:写作辅助、设计建议

LoRA微调最佳实践指南

1. 数据准备要点

-

质量优先:1000条高质量数据胜过10万条垃圾数据

-

格式统一:保持指令-输入-输出的一致性

-

场景覆盖:确保数据覆盖目标任务的各种情况

2. 参数调优建议

-

LoRA秩(r):8、16、32、64、128,根据任务复杂度选择

-

学习率:2e-4是不错的起点

-

批次大小:根据显存调整,通常2-8

3. 硬件配置推荐

-

7B模型:24GB显存(RTX 4090)

-

13B模型:32GB显存或QLoRA

-

70B模型:QLoRA + 多卡部署

性能对比与优势分析

| 指标 | 全参数微调 | LoRA微调 | QLoRA微调 |

|---|---|---|---|

| 参数更新比例 | 100% | 1-10% | 1-10% |

| 显存需求 | 巨大 | 中等 | 极小 |

| 训练时间 | 长 | 短 | 短 |

| 部署难度 | 高 | 低 | 低 |

| 成本 | 高 | 低 | 极低 |

完整可运行代码

下面是一个完整的LoRA微调示例,包含模型加载、数据准备、训练和推理:

#!/usr/bin/env python

# -*- coding: utf-8 -*-

"""

LoRA微调完整示例:将通用大模型转换为专业领域助手

"""

# 导入必要库

from unsloth import FastLanguageModel

import torch

from datasets import Dataset

from trl import SFTTrainer

from transformers import TrainingArguments

class LoRATrainer:

def __init__(self, model_name="Qwen2.5-7B"):

self.model_name = model_name

self.model = None

self.tokenizer = None

def load_model(self):

"""加载预训练模型"""

print("正在加载模型...")

self.model, self.tokenizer = FastLanguageModel.from_pretrained(

model_name=self.model_name,

max_seq_length=2048,

dtype=None,

load_in_4bit=True,

)

print("模型加载完成!")

def add_lora_adapter(self, r=16, lora_alpha=16):

"""添加LoRA适配器"""

print("正在添加LoRA适配器...")

self.model = FastLanguageModel.get_peft_model(

self.model,

r=r,

target_modules=["q_proj", "k_proj", "v_proj", "o_proj",

"gate_proj", "up_proj", "down_proj"],

lora_alpha=lora_alpha,

lora_dropout=0,

bias="none",

use_gradient_checkpointing="unsloth",

random_state=3407,

)

print("LoRA适配器添加完成!")

def prepare_dataset(self, data_list):

"""准备训练数据集"""

# 定义提示模板

prompt_template = """你是一个专业的助手。请根据用户的问题提供准确的回答。

### 问题:

{}

### 回答:

{}"""

EOS_TOKEN = self.tokenizer.eos_token

def formatting_prompts_func(examples):

inputs = examples["input"]

outputs = examples["output"]

texts = []

for input, output in zip(inputs, outputs):

text = prompt_template.format(input, output) + EOS_TOKEN

texts.append(text)

return {"text": texts}

# 转换为Dataset并格式化

dataset = Dataset.from_list(data_list)

dataset = dataset.map(formatting_prompts_func, batched=True)

return dataset

def train(self, dataset, max_steps=60, learning_rate=2e-4):

"""训练模型"""

print("开始训练...")

# 设置训练参数

training_args = TrainingArguments(

per_device_train_batch_size=2,

gradient_accumulation_steps=4,

warmup_steps=5,

max_steps=max_steps,

learning_rate=learning_rate,

fp16=not torch.cuda.is_bfloat16_supported(),

bf16=torch.cuda.is_bfloat16_supported(),

logging_steps=1,

optim="adamw_8bit",

weight_decay=0.01,

lr_scheduler_type="linear",

seed=3407,

output_dir="outputs",

report_to="none",

)

# 创建训练器

trainer = SFTTrainer(

model=self.model,

tokenizer=self.tokenizer,

train_dataset=dataset,

dataset_text_field="text",

max_seq_length=2048,

dataset_num_proc=2,

packing=False,

args=training_args,

)

# 开始训练

trainer_stats = trainer.train()

print("训练完成!")

return trainer_stats

def save_model(self, save_path="lora_model"):

"""保存模型"""

self.model.save_pretrained(save_path)

self.tokenizer.save_pretrained(save_path)

print(f"模型已保存到: {save_path}")

def load_finetuned_model(self, model_path="lora_model"):

"""加载微调后的模型"""

self.model, self.tokenizer = FastLanguageModel.from_pretrained(

model_name=model_path,

max_seq_length=2048,

dtype=None,

load_in_4bit=True,

)

def inference(self, question, max_new_tokens=256):

"""模型推理"""

FastLanguageModel.for_inference(self.model)

prompt = f"""你是一个专业的助手。请根据用户的问题提供准确的回答。

### 问题:

{question}

### 回答:

"""

inputs = self.tokenizer(

[prompt],

return_tensors="pt"

).to("cuda")

from transformers import TextStreamer

text_streamer = TextStreamer(self.tokenizer)

_ = self.model.generate(

**inputs,

streamer=text_streamer,

max_new_tokens=max_new_tokens,

temperature=0.7,

top_p=0.9,

)

# 使用示例

def main():

# 创建训练器

trainer = LoRATrainer()

# 加载模型

trainer.load_model()

# 添加LoRA适配器

trainer.add_lora_adapter()

# 准备训练数据

train_data = [

{

"input": "你好,介绍一下你自己",

"output": "我是基于大语言模型的AI助手,可以回答问题、创作文字,如写故事、写公文、写邮件、写剧本等,还能表达观点,玩游戏等。"

},

{

"input": "如何学习AI技术?",

"output": "学习AI技术建议:1. 打好数学基础(线性代数、概率论);2. 学习编程(Python);3. 掌握机器学习基础;4. 实践项目;5. 关注前沿技术。"

}

]

dataset = trainer.prepare_dataset(train_data)

# 开始训练

trainer.train(dataset, max_steps=10)

# 保存模型

trainer.save_model("my_lora_model")

# 测试推理

trainer.load_finetuned_model("my_lora_model")

trainer.inference("如何学习AI技术?")

if __name__ == "__main__":

main()

结语

LoRA微调技术的出现,让大模型的应用门槛大大降低。无论是个人开发者还是企业用户,都可以通过这项技术快速构建专业领域的AI助手。随着技术的不断发展,我们有理由相信,未来的AI将更加个性化、专业化,真正成为我们工作和生活中的得力助手!

赶紧试试LoRA微调吧,让你的大模型从此脱胎换骨!

本文由AI技术博主原创,转载请注明出处。关注我,带你解锁更多AI神器!

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)