基于 Rust 实现单向网闸(Data Diode)环境下的 Kafka 实时跨网传输

物理隔离环境下的数据互联是工业互联网落地的“最后一公里”难题。网闸连接器 (Data Diode Connector, DDC) 提供了一种低成本、非侵入式、高可靠的软件解决方案,有效替代了传统昂贵的硬件模块或不稳定的脚本方案。目前,DDC 提供免费的试用版,供个人开发者与中小项目使用,您可以直接通过 Docker Hub 拉取镜像进行测试与部署。对于需要生产环境使用、高级纠错特性或定制协议适配的

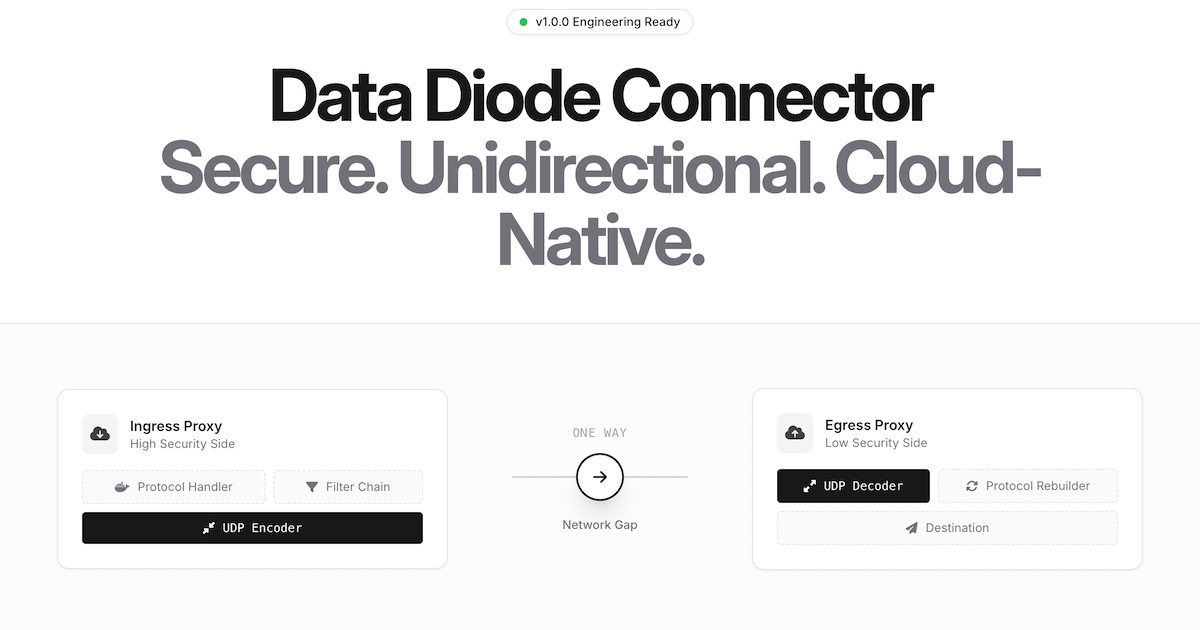

摘要:在工业互联网与关键信息基础设施保护(CIIP)场景中,物理单向网闸(Data Diode/光闸)的部署虽然提升了安全边界,但也阻断了 TCP/IP 协议的双向通信能力,导致 Kafka、MQTT 等通信协议无法实时跨网同步数据。本文将从网络协议层深度剖析该问题的根源,并介绍一种基于 Rust 语言开发的解决方案——网闸连接器 (Data Diode Connector, DDC)。该方案通过双端代理架构与可靠 UDP 协议封装,实现了 850Mbps 线速 下的毫秒级单向数据穿透。

1. 背景与技术挑战

在电力、水务、能源、工业等行业的数字化转型过程中,架构师常面临一个核心矛盾:业务数据的实时互联需求与合规性的物理隔离要求。

通常,在生产控制区(OT)与管理信息区(IT)之间会部署“物理单向导入装置”(光闸)。这种设备利用光的单向传播特性,物理上切断了所有反向信号传输。

协议层面的根本冲突

Apache Kafka 及其依赖的 TCP 协议栈,在设计上假定网络是**全双工(Full Duplex)**的。在单向网络环境中,直接连接面临以下阻碍:

- TCP 握手失败:Kafka Producer 发出的

SYN包可以到达目标,但目标回复的SYN-ACK确认包会被网闸物理阻断。发送端因收不到确认而判定连接超时。 - 应用层交互依赖:即使网络层联通,Kafka 协议本身也存在强交互逻辑。

- 元数据同步:Producer 需从 Controller 获取集群元数据。

- 生产确认(ACKs):Producer 发送消息后需等待 Broker 的持久化确认。

因此,标准的 Kafka 协议无法直接穿透物理网闸。

2. 现有方案的局限性分析

面对这一挑战,工程现场通常采用以下两种传统方案,但均存在显著缺陷:

2.1 文件摆渡方案 (File Transfer)

原理:源端将数据批量写入文件(CSV/JSON),通过网闸原生提供的文件通道传输,目的端监听文件变化并导入。

缺陷:

- 高延迟:通常为分钟级甚至小时级,无法满足实时监控告警需求。

- IO 瓶颈:频繁的磁盘读写易成为系统瓶颈,且需处理复杂的文件积压与清理逻辑。

2.2 原始 UDP 透传方案 (Raw UDP)

原理:开发简单的 UDP Socket 程序进行数据转发。

缺陷:

- 可靠性差:UDP 是无连接协议,缺乏确认机制。在网络波动或网闸缓冲区溢出时,会发生静默丢包。

- 无序性:无法保证消息到达的顺序,且不支持大包的分片与重组(受限于 MTU)。

3. 解决方案:网闸连接器架构设计

为了解决上述问题,本项目实现了一套专为单向恶劣网络环境设计的协议转换与传输中间件——网闸连接器 (Data Diode Connector, DDC)。

3.1 核心架构:双端代理 (Dual-Proxy)

系统采用“双端代理 + 私有协议隧道”的设计模式,将双向的 Kafka 交互终结在各自的安全区内,中间跨网段采用经优化的单向 UDP 协议。

- 入口代理 (Ingress Proxy):

- 扮演 Kafka Consumer 角色,主动拉取源端数据。

- 协议适配:将 Kafka Record 序列化为紧凑的二进制流。

- 流量整形 (Traffic Shaping):支持精确匹配网闸的物理带宽,防止缓冲区溢出。

- 单向传输通道:

- 使用定制的 UDP 协议,增加头部校验与序列号。

- (企业版特性) 支持前向纠错 (FEC),通过冗余数据包恢复部分丢失数据。

- 出口代理 (Egress Proxy):

- 接收 UDP 数据流,进行分片重组与序列号校验。

- 扮演 Kafka Producer 角色,将还原后的数据写入目标 Kafka 集群。

3.2 技术选型:Why Rust?

对于此类网络基础设施组件,性能的确定性与内存安全性至关重要。

- 零 GC 停顿:避免了 Java/Go 在高吞吐场景下的 GC 延迟抖动,确保微秒级的处理时延。

- 内存安全:Rust 的所有权机制在编译期杜绝了缓冲区溢出等常见安全漏洞,符合工业安全的高标准。

- 极高性能:实测在国产化 ARM64 服务器 + 千兆光闸环境下,单进程吞吐量达到 850 Mbps,CPU 占用率低于 20%。

4. 快速部署指南

网闸连接器提供了标准的 Docker 镜像,支持通过 Docker Compose 快速编排。无需修改现有业务代码,即可建立跨网链路。

场景假设:

- 源端 Kafka:

192.168.1.100:9092 - 目标 Kafka:

172.16.0.5:9092 - 网闸单向通道:

10.10.10.2:9092

步骤 1:源端部署 (Ingress)

在源端网络部署 Ingress 服务,负责采集与发送。

# docker-compose-ingress.yaml

version: '3.8'

services:

# Reads data from Kafka and writes to Socket

# Replace this service with ph-udp-ingress image and corresponding parameters if input source is UDP

ph-kafka-ingress:

image: ffutop/ddc-ph-kafka-ingress:latest

restart: always

volumes:

- shared-socket:/shared

networks:

- ddc-ingress-net

entrypoint: ["/ph_kafka_ingress"]

command:

- "--host_kafka_server"

- "192.168.1.100"

- "--port_kafka_server"

- "9092"

- "--topic_name"

- "TestTopic"

- "--socket_path"

- "/shared/socket_ph_out.sock"

# Reads data from Socket and sends via UDP

transport-udp-send:

image: ffutop/ddc-transport-udp-send:latest

restart: always

depends_on:

- ph-kafka-ingress

volumes:

- shared-socket:/shared

networks:

- ddc-ingress-net

cap_add:

- SYS_NICE

entrypoint: ["/transport_udp_send"]

command:

- "--receiver_address"

- "10.10.10.2"

- "--receiver_port"

- "9092"

- "--socket_path"

- "/shared/socket_ph_out.sock"

volumes:

shared-socket:

networks:

ddc-ingress-net:

步骤 2:目的端部署 (Egress)

在目的端网络部署 Egress 服务,负责接收与写入。

# docker-compose-egress.yaml

version: '3.8'

services:

# Receives UDP data and writes to Socket

transport-udp-receive:

image: ffutop/ddc-transport-udp-receive:latest

restart: always

volumes:

- shared-socket:/shared

networks:

- ddc-egress-net

ports:

- "1234:1234/udp" # Expose receiver port

cap_add:

- SYS_NICE

entrypoint: ["/transport_udp_receive"]

command:

- "--receiver_address"

- "0.0.0.0"

- "--receiver_port"

- "1234"

- "--socket_path"

- "/shared/socket_transport_out.sock"

# Reads data from Socket and sends to Kafka

# Replace this service with ph-udp-egress image and corresponding parameters if UDP Egress is needed

ph-kafka-egress:

image: ffutop/ddc-ph-kafka-egress:latest

restart: always

depends_on:

- transport-udp-receive

volumes:

- shared-socket:/shared

networks:

- ddc-egress-net

entrypoint: ["/ph_kafka_egress"]

command:

- "--host_kafka_server"

- "172.16.0.5"

- "--port_kafka_server"

- "9092"

- "--socket_path"

- "/shared/socket_transport_out.sock"

volumes:

shared-socket:

networks:

ddc-egress-net:

5. 总结与试用

物理隔离环境下的数据互联是工业互联网落地的“最后一公里”难题。网闸连接器 (Data Diode Connector, DDC) 提供了一种低成本、非侵入式、高可靠的软件解决方案,有效替代了传统昂贵的硬件模块或不稳定的脚本方案。

目前,DDC 提供免费的试用版,供个人开发者与中小项目使用,您可以直接通过 Docker Hub 拉取镜像进行测试与部署。对于需要生产环境使用、高级纠错特性或定制协议适配的企业级需求,我们也提供商业技术支持。

获取软件镜像:请访问 Docker Hub 搜索 ffutop/ddc-transport-udp-receive 和 ffutop/ddc-transport-udp-send 等镜像。

获取 Kubernetes Helm Chart:请访问 Artifact Hub 下载最新的 data-diode-connector-ingress 和 data-diode-connector-egress 以便在 Kubernetes 环境中部署。

获取使用文档:请访问网闸连接器官网

关于作者:

专注于工业互联网领域。致力于解决工业现场的数据孤岛问题。如果您在网闸穿透方面遇到技术难题,或希望获取更详细的部署白皮书,欢迎私信交流。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)