自制网络爬虫获取网页超链接脚本

网络爬虫,俗称“网络蜘蛛”或“网络机器人”,是一种自动访问万维网并从中抓取信息的程序。随着互联网信息量的剧增,网络爬虫已成为数据挖掘、搜索引擎优化(SEO)、市场研究等领域的关键工具。本章旨在介绍网络爬虫的基本概念、功能和工作原理,为读者打开网络爬虫世界的大门。网络爬虫是一种自动化脚本或程序,其主要任务是在互联网上进行网页的遍历、信息的抓取和数据的收集。根据其抓取策略和用途的不同,网络爬虫可分为以

简介:网络爬虫是IT领域的基础技能,可自动化处理网页数据。本项目介绍了一个自编脚本 GetHtml.py ,用于从网页中提取超链接,这是网络爬虫的一个基础功能。实现该功能包括发送HTTP请求、解析HTML以及提取超链接的过程。代码可能使用了Python的 requests 库来发送请求,以及 BeautifulSoup 库进行HTML解析。学习此项目能帮助理解网络爬虫工作原理,为数据抓取等提供支持,并可进一步学习异常处理、多线程和正则表达式等技术。

1. 网络爬虫基础技能介绍

网络爬虫,俗称“网络蜘蛛”或“网络机器人”,是一种自动访问万维网并从中抓取信息的程序。随着互联网信息量的剧增,网络爬虫已成为数据挖掘、搜索引擎优化(SEO)、市场研究等领域的关键工具。本章旨在介绍网络爬虫的基本概念、功能和工作原理,为读者打开网络爬虫世界的大门。

1.1 网络爬虫的定义与分类

网络爬虫是一种自动化脚本或程序,其主要任务是在互联网上进行网页的遍历、信息的抓取和数据的收集。根据其抓取策略和用途的不同,网络爬虫可分为以下几类:

- 通用爬虫:旨在为搜索引擎提供原始数据,常见的如谷歌、必应的爬虫。

- 聚焦爬虫:专注于特定主题或领域的信息抓取。

- 元搜索引擎爬虫:旨在为元搜索引擎提供多个搜索引擎的结果。

1.2 网络爬虫的工作流程

一个基本的网络爬虫通常遵循以下步骤:

- URL管理 :从种子URL(初始访问链接)开始,维护一个待访问的URL队列。

- 发送请求 :爬虫通过HTTP协议向服务器请求网页内容。

- 内容解析 :将获取的网页内容解析,提取出新的URL和所需信息。

- 数据存储 :将提取的数据存储于数据库或文件系统中。

- 遵守规则 :遵守robots.txt协议,尊重网站的抓取规则。

1.3 网络爬虫的法律和道德边界

网络爬虫虽然功能强大,但在使用时必须遵循相关法律法规。例如,网站的robots.txt文件定义了爬虫可以访问的页面,避免抓取私人或受版权保护的数据。此外,频繁的请求可能会对网站服务器造成负担,因此合理控制爬虫的访问频率和时长也是必要的。在进行爬虫开发和应用时,应确保遵守网络道德和法律法规,做到合理合法地采集和使用网络数据。

2. 获取网页超链接的实现步骤

在本章中,我们将深入探讨如何实现获取网页超链接的具体步骤。首先,分析网页结构来理解超链接的HTML表示方式;接着,讨论不同的超链接提取方法;最后,通过示例代码说明如何将理论应用于实践。

2.1 网页结构分析

2.1.1 HTML标签与属性

HTML(HyperText Markup Language)是构成网页的基础。它通过标签和属性定义了网页内容的结构和布局。一个基本的HTML标签结构包含开始标签、属性(可选)、内容和结束标签,例如:

<a href="http://example.com">Visit Example</a>

这里的 <a> 是锚(anchor)标签,用于定义超链接; href 是超链接地址的属性;而 Visit Example 是链接的显示文本。

2.1.2 超链接的HTML表示

超链接通常由 <a> 标签表示,它具有一个 href 属性,该属性指向链接的目标地址。例如:

<a href="https://www.itprofessional.com/article/123">Read More</a>

在这个例子中, https://www.itprofessional.com/article/123 是超链接指向的URL,而”Read More”是被点击的文本部分。超链接可以指向不同类型的资源,包括其他网页、图片、文档等。

2.2 超链接提取方法概述

2.2.1 正则表达式提取法

正则表达式(Regular Expression)是一种强大的文本处理工具,可以用来识别和提取符合特定模式的字符串。对于超链接的提取,可以利用正则表达式匹配 <a> 标签和 href 属性。

举例来说,一个简单的正则表达式模式如下:

<a\s+(?:[^>]*?\s+)?href="([^"]*)"

这个模式可以匹配 <a> 标签内的 href 属性,并捕获其值。正则表达式中的特殊字符和量词(如 \s+ 、 [^>]*? 、 ([^"]*) )都有特定的含义和作用。

2.2.2 HTML解析库提取法

相比正则表达式,HTML解析库(如BeautifulSoup)提供了一种更为稳健和灵活的方式来解析和遍历HTML文档。它们可以将HTML文档转换成一个树形结构,允许我们像访问Python数据结构一样方便地访问和搜索HTML中的元素。

使用HTML解析库提取超链接的步骤通常包括:

1. 导入库并解析HTML文档。

2. 定位到 <a> 标签。

3. 提取每个 <a> 标签中的 href 属性值。

from bs4 import BeautifulSoup

import requests

# 获取网页内容

url = 'https://www.itprofessional.com'

response = requests.get(url)

html_content = response.text

# 解析HTML

soup = BeautifulSoup(html_content, 'html.parser')

links = soup.find_all('a')

# 提取所有超链接

for link in links:

href = link.get('href')

if href:

print(href)

上述代码使用requests库获取网页内容,然后使用BeautifulSoup解析该内容并查找所有的 <a> 标签。之后遍历这些标签并打印出 href 属性值,即超链接地址。

3. 发送HTTP请求的Python代码示例

3.1 使用requests库发送请求

3.1.1 requests库的安装和配置

在Python中, requests 是一个非常流行的HTTP库,它被广泛用于发送网络请求。要安装 requests 库,你可以使用pip命令:

pip install requests

安装完成后,在Python脚本中导入库:

import requests

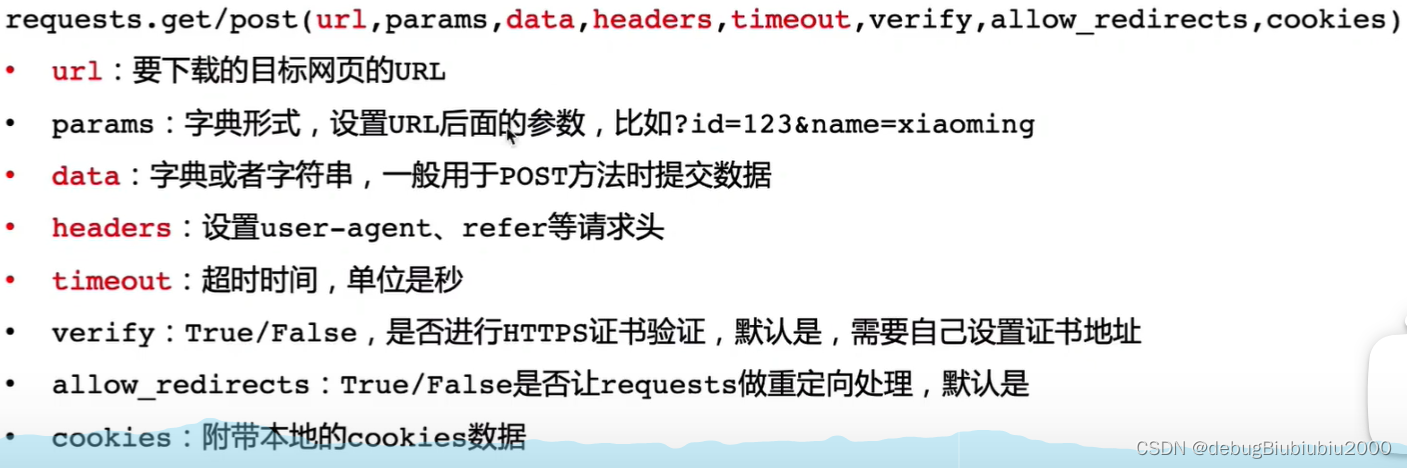

在开始编写代码之前,需要了解 requests 库的一些基础知识。库中的主要方法包括 get() 和 post() ,分别用于发送GET和POST请求。 requests 库的设计非常直观,允许你以非常简单的方式发送和接收数据。

3.1.2 GET和POST请求的发送

GET请求示例

GET请求通常用于从服务器检索数据。下面是一个简单的GET请求示例,用于从一个假设的API获取数据:

import requests

# 发送GET请求

response = requests.get('https://api.example.com/data')

# 打印响应状态码

print(response.status_code)

# 打印响应文本

print(response.text)

POST请求示例

POST请求用于向服务器发送数据,例如提交表单。下面是一个POST请求的示例:

import requests

# 设置POST请求的参数

data = {'key1': 'value1', 'key2': 'value2'}

# 发送POST请求

response = requests.post('https://api.example.com/submit', data=data)

# 打印响应状态码

print(response.status_code)

# 打印响应文本

print(response.text)

在这些示例中,我们首先导入了 requests 库,然后使用 get() 或 post() 方法发送请求。 requests.get() 和 requests.post() 方法分别用于创建GET和POST请求。这些方法返回一个 Response 对象,该对象包含服务器对请求的响应。使用 .status_code 可以获取响应的状态码,而 .text 则可以获取响应的文本内容。

3.2 解析响应内容

3.2.1 响应状态码的判断

响应状态码告诉客户端服务器处理请求的结果。通常,状态码200表示请求成功,而4xx系列状态码表示客户端错误,5xx系列状态码表示服务器错误。

# 继续使用之前的GET请求示例

# 判断响应状态码

if response.status_code == 200:

print("请求成功!")

elif response.status_code == 404:

print("未找到资源!")

elif response.status_code == 500:

print("服务器内部错误!")

else:

print(f"其他错误:{response.status_code}")

在这段代码中,我们通过比较 response.status_code 的值来判断响应状态,并打印出相应的信息。

3.2.2 响应文本的处理

获取到响应文本后,可能需要解析这些数据,以便进一步处理。假设响应文本是一个JSON格式的字符串,可以使用 json.loads() 方法进行解析:

import json

# 假设response.text包含了JSON格式的字符串

json_data = json.loads(response.text)

# 假设我们需要获取某个键的值

value = json_data.get('key')

print(value)

这里,我们首先导入了 json 模块,然后使用 json.loads() 方法将JSON字符串转换为Python字典,之后可以按照字典的方式访问所需的数据。

整个代码块详细展示了如何使用 requests 库发送HTTP请求,并根据返回的响应进行判断和处理。通过这种方式,爬虫可以从服务器获取数据,并根据需要进行进一步的操作。

4. HTML解析与超链接提取

在本章中,我们将深入探讨如何使用Python中的HTML解析库来提取网页中的超链接。提取超链接是网络爬虫的一项基本任务,它能够帮助我们发现网络上更多的资源。我们将使用Python中广泛使用的库BeautifulSoup来解析HTML并提取超链接。

4.1 使用BeautifulSoup解析HTML

BeautifulSoup是一个可以从HTML或XML文件中提取数据的Python库。它能够遍历、搜索、修改解析树等。这一小节将介绍BeautifulSoup的基本使用方法和HTML文档结构的解析。

4.1.1 BeautifulSoup库的基本使用

要安装BeautifulSoup,可以使用pip:

pip install beautifulsoup4

对于解析HTML,通常需要配合一个解析器。常用的解析器包括 lxml 和 html.parser 。安装 lxml :

pip install lxml

下面是一个简单的例子,展示了如何使用BeautifulSoup解析一段HTML内容:

from bs4 import BeautifulSoup

html_doc = """

<html>

<head>

<title>Sample Page</title>

</head>

<body>

<p class="title"><b>The Dormouse's story</b></p>

<a href="http://example.com/one" id="link1">Link 1</a>

<a href="http://example.com/two" id="link2">Link 2</a>

</body>

</html>

soup = BeautifulSoup(html_doc, 'lxml')

print(soup.prettify())

在上述代码中,我们首先导入了 BeautifulSoup 类,并创建了一个实例 soup 。 html_doc 是我们要解析的HTML内容。通过指定’lxml’作为解析器,我们能够更快速地解析HTML文档。 prettify 方法将输出格式化后的HTML文档,有助于阅读和调试。

4.1.2 解析HTML文档结构

BeautifulSoup通过不同的方法来遍历和搜索文档树。例如,我们可以使用 find 和 find_all 方法来定位HTML标签:

title = soup.find('p', class_='title')

print(title.text)

for link in soup.find_all('a'):

print(link.get('href'))

在上面的代码中, find 方法返回文档中第一个匹配的标签,而 find_all 方法返回所有匹配的标签。通过传递参数 class_='title' 给 find 方法,我们定位了类名为”title”的第一个 <p> 标签,并打印出它的文本内容。 find_all 方法用于找到所有 <a> 标签并打印它们的 href 属性。

4.2 实践:提取网页中的所有超链接

本小节将实际应用BeautifulSoup来提取一个真实网页中的所有超链接。

4.2.1 遍历HTML节点

为了遍历HTML节点,我们需要获取实际的网页内容。我们将使用 requests 库来获取网页内容。

import requests

from bs4 import BeautifulSoup

response = requests.get('https://www.example.com')

soup = BeautifulSoup(response.text, 'lxml')

for tag in soup.find_all(True):

if tag.name == 'a':

print(tag.get('href'))

在上述代码中,我们首先使用 requests.get 方法获取了”https://www.example.com”的HTML内容。然后,我们使用BeautifulSoup解析这些内容,并通过 find_all 方法找出所有的HTML标签。 if tag.name == 'a': 这一行检查了标签名是否为 <a> ,如果是,则打印出该标签的 href 属性值。

4.2.2 提取超链接并存储

提取超链接后,我们可能需要将它们存储到某种数据结构中,以便进一步使用。

links = [link.get('href') for link in soup.find_all('a', href=True)]

print(links)

这段代码使用列表推导式来创建一个包含所有超链接的列表。我们通过 find_all 方法定位所有 <a> 标签,并通过 href=True 确保只获取那些拥有 href 属性的标签。最终,我们打印出这个列表。

数据结构分析

| 数据结构 | 描述 |

|---|---|

| 列表 | 用于存储一系列的超链接。列表是动态的,可以随时添加新的超链接,也可以按照需求删除不需要的超链接。列表中的每个元素都是一个超链接的URL,是字符串类型。 |

通过上述步骤,我们已经能够使用Python和BeautifulSoup库来解析HTML文档并提取其中的超链接。这为网络爬虫提供了基本的数据采集能力,为进一步的数据处理和分析奠定了基础。

5. Python编程在爬虫中的应用

5.1 Python数据结构在爬虫中的应用

5.1.1 列表和字典的使用

在爬虫项目中,列表和字典是存储和处理数据的重要数据结构。列表(List)允许我们存储一个有序的元素集合,这些元素可以是任何类型,包括其他数据结构。字典(Dictionary)则是无序的键值对集合,它允许我们通过键快速访问对应的值。这两种数据结构在爬虫的数据抓取、存储与处理中都发挥着巨大的作用。

列表通常用于存储从网页中抓取的数据集合,比如文章列表、图片URL等。例如:

articles = []

response = requests.get("http://example.com/articles")

articles_html = response.text

articles = BeautifulSoup(articles_html, 'html.parser').find_all('article')

for article in articles:

title = article.find('h1').get_text()

link = article.find('a')['href']

articles.append({'title': title, 'link': link})

字典则在需要通过唯一键来快速存取数据时更为适用。在爬虫中,字典常用于存储每个页面的特定信息,如元数据、配置参数等。

5.1.2 集合和队列的使用

集合(Set)是Python中一种无序且元素唯一的容器,它在爬虫中主要用于去重。例如,在处理多个页面的数据时,可能希望去除重复的内容,这时可以利用集合的特性来实现。

unique_links = set()

for page in all_pages:

links = get_links_from_page(page)

unique_links.update(links)

队列(Queue)是一种先进先出(FIFO)的数据结构,它适用于在爬虫中管理待访问的URL列表。当一个爬虫需要按照特定的顺序来访问网页时,队列可以确保按照添加顺序的顺序来进行抓取。

from collections import deque

queue = deque()

start_urls = ["http://example.com"]

queue.extend(start_urls)

while queue:

current_url = queue.popleft()

response = requests.get(current_url)

process_page(response)

next_urls = get_next_urls(response)

queue.extend(next_urls)

5.2 爬虫程序的逻辑实现

5.2.1 爬虫的工作流程

爬虫程序的工作流程通常遵循以下步骤:

- 初始化:设置爬虫的起始URL列表。

- 请求:按照一定的顺序从队列中取出URL,使用HTTP库发送请求,获取响应内容。

- 解析:对响应的内容进行解析,提取出有用的数据和新的待访问的链接。

- 存储:将提取的数据保存到文件系统、数据库或其他存储系统中。

- 索引:建立反向链接索引,便于后续查询。

- 循环:重复步骤2-5,直到满足停止条件,如达到最大抓取深度、抓取任务完成等。

5.2.2 代码组织和模块化

为了提高爬虫代码的可维护性和可扩展性,对爬虫程序进行适当的模块化设计至关重要。通常,一个爬虫项目可以拆分成以下几个模块:

- 配置模块:用于存储爬虫配置信息,比如请求头、代理列表、抓取策略等。

- 网络模块:负责发送请求和接收响应,可以使用requests库。

- 解析模块:使用BeautifulSoup或lxml库来解析HTML文档。

- 数据存储模块:负责数据的存储,可以是文件、数据库或缓存系统。

- 任务管理模块:用于管理待访问的URL,通常使用队列结构来实现。

- 日志模块:记录爬虫的运行状态和错误信息,便于问题追踪和性能分析。

下面是一个简单的模块化爬虫代码示例:

# config.py

USER_AGENT = 'Mozilla/5.0'

# crawler.py

from config import USER_AGENT

from queue_module import URLQueue

from parser import parse

from storage import save_data

queue = URLQueue()

queue.add('http://example.com/start_page')

while not queue.empty():

url = queue.get()

response = requests.get(url, headers={'User-Agent': USER_AGENT})

if response.status_code == 200:

parsed_data = parse(response.text)

save_data(parsed_data)

new_urls = extract_new_urls(response.text)

queue.add(new_urls)

# parser.py

def parse(html_content):

# ... 解析逻辑 ...

# storage.py

def save_data(data):

# ... 存储逻辑 ...

# queue_module.py

class URLQueue:

# ... 队列逻辑 ...

以上代码结构通过模块化的方式组织了爬虫的不同功能,使得整个程序更加清晰和易于管理。通过这种结构,我们可以在不同模块中添加更复杂的逻辑,而不影响整个系统的其他部分。

6. 进阶技术(异常处理、多线程、正则表达式)

6.1 异常处理机制的实现

在编写爬虫程序时,异常处理是确保程序稳定运行的关键。异常主要分为两大类:系统异常和用户自定义异常。系统异常是由程序外部因素引发的,如网络问题、文件损坏等。用户自定义异常是指我们根据程序运行的需要,为特定情况设计的异常。

6.1.1 异常的类型和捕获

Python中常见的异常类型包括 SyntaxError 、 IndentationError 、 TypeError 、 KeyError 等。异常可以通过try-except语句块来捕获处理,确保程序在遇到错误时不会直接崩溃,而是执行异常处理逻辑。

try:

# 可能出现错误的代码

response = requests.get('http://example.com')

response.raise_for_status() # 如果状态码不是200,则会抛出HTTPError异常

except requests.exceptions.HTTPError as http_err:

# 处理HTTP相关的异常

print(f'HTTP error occurred: {http_err}')

except requests.exceptions.ConnectionError as conn_err:

# 处理连接错误的异常

print(f'Error connecting to the server: {conn_err}')

except requests.exceptions.Timeout as timeout_err:

# 处理请求超时的异常

print(f'Timeout error: {timeout_err}')

except requests.exceptions.RequestException as req_err:

# 处理所有requests模块引发的异常

print(f'Error in requests to the server: {req_err}')

except Exception as e:

# 处理其他所有类型的异常

print(f'An error occurred: {e}')

6.1.2 自定义异常处理策略

在爬虫中,我们可以定义一些异常类来处理特定情况,例如,响应内容不是预期格式时,可以抛出自定义的 InvalidResponseException 。

class InvalidResponseException(Exception):

"""自定义异常类,处理无效响应"""

def __init__(self, message):

super().__init__(message)

try:

# 假设我们需要解析某个特定格式的JSON数据

data = response.json()

if not isinstance(data, dict):

raise InvalidResponseException('Response format is invalid.')

except ValueError as e:

# 处理数据解析错误

print(f'ValueError occurred while parsing the response: {e}')

except InvalidResponseException as e:

# 处理无效响应异常

print(e)

6.2 多线程在爬虫中的应用

多线程编程是提高爬虫效率的常用手段之一,通过并发请求多个URL,可以在同一时间内获取更多的数据。

6.2.1 多线程的基本概念

多线程是指在一个程序中可以同时运行多个线程执行不同的任务。在Python中,可以使用标准库中的 threading 模块来创建和管理线程。

6.2.2 Python中的多线程编程

在使用多线程进行网络爬取时,需要考虑线程安全问题,避免数据的相互冲突。 threading 模块中的 Lock 可以用来确保线程间的安全。

import threading

import requests

def fetch_url(url, lock):

with lock:

response = requests.get(url)

# 处理响应数据...

# 创建锁

lock = threading.Lock()

# 创建线程列表

threads = []

urls = ['http://example.com/page1', 'http://example.com/page2', ...]

for url in urls:

thread = threading.Thread(target=fetch_url, args=(url, lock))

threads.append(thread)

thread.start()

# 等待所有线程完成

for thread in threads:

thread.join()

6.3 正则表达式在超链接提取中的应用

正则表达式是一种强大的文本匹配工具,能够灵活地识别符合特定规则的字符串。

6.3.1 正则表达式的构建和测试

构建正则表达式需要对目标文本的结构有所了解。例如,提取网页中所有的超链接,可以使用正则表达式 \bhttps?://[^\s()<>]+(?:$[\w\d]+$) 。

6.3.2 提高提取效率的正则表达式技巧

在提取超链接时,可以使用非贪婪匹配和前瞻断言来优化正则表达式,以提高匹配效率。

import re

# 示例代码,使用正则表达式提取超链接

html = '<a href="https://example.com/page1">Page 1</a> <a href="https://example.com/page2">Page 2</a>'

urls = re.findall(r'href="([^"]+)"', html)

print(urls)

通过优化正则表达式的结构,可以提升匹配的性能,尤其是当处理大量文本时。例如,避免在正则表达式中使用重复的分组,因为每次匹配时分组都会被保存下来,这可能会增加额外的处理开销。

在使用正则表达式提取超链接时,还需要注意编码和转义问题,正确处理URL中的特殊字符,确保提取的链接是有效的。此外,正则表达式编译后的使用也比直接使用更高效。

简介:网络爬虫是IT领域的基础技能,可自动化处理网页数据。本项目介绍了一个自编脚本 GetHtml.py ,用于从网页中提取超链接,这是网络爬虫的一个基础功能。实现该功能包括发送HTTP请求、解析HTML以及提取超链接的过程。代码可能使用了Python的 requests 库来发送请求,以及 BeautifulSoup 库进行HTML解析。学习此项目能帮助理解网络爬虫工作原理,为数据抓取等提供支持,并可进一步学习异常处理、多线程和正则表达式等技术。

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)